신뢰할 수 있는 컨텍스트가 있는 RAG

AI 애플리케이션은 사용자 신뢰를 구축하기 위해 정확한 결과를 대규모로 제공해야 합니다. Elasticsearch 하이브리드 검색의 정확성으로 대규모 언어 모델(LLM)을 강화하고, 지연 시간이 짧고 효율성이 높은 검색 증강 생성(RAG)을 확장하세요.

뛰어난 정확도와 효율적인 벡터 확장을 위해 구축된 RAG

실제 운영 환경에서 필요한 벡터 성능, 비용 효율성, 보안을 통해 적절한 컨텍스트를 제공합니다.

하이브리드 검색, 시맨틱 순위 재지정, 타사 또는 네이티브로 제공되는 동급 최강의 Jina AI 모델을 사용한 기본 제공 추론으로 RAG 애플리케이션에 적절한 컨텍스트를 제공하세요. 단순한 벡터 전용 검색을 키워드, 벡터, 필터를 혼합한 단일 쿼리로 대체하세요.

정형, 비정형, 벡터 데이터가 포함된 수십억 개의 문서에서 검색 품질과 비용 사이의 절충 없이 컨텍스트를 확장할 수 있습니다. DiskBBQ와 같은 정량화 및 디스크 최적화 알고리즘은 짧은 지연 시간으로 높은 순위 품질을 유지하면서 최대 95%까지 메모리를 줄입니다.

통합 플랫폼을 사용하여 단일 쿼리로 문서 및 비정형, 정형 기록에서 컨텍스트를 가져와 파이프라인을 단순화하세요. 문서 수준 및 역할 기반 액세스 제어를 적용하면 LLM이 사용자가 볼 수 있는 데이터만 노출합니다.

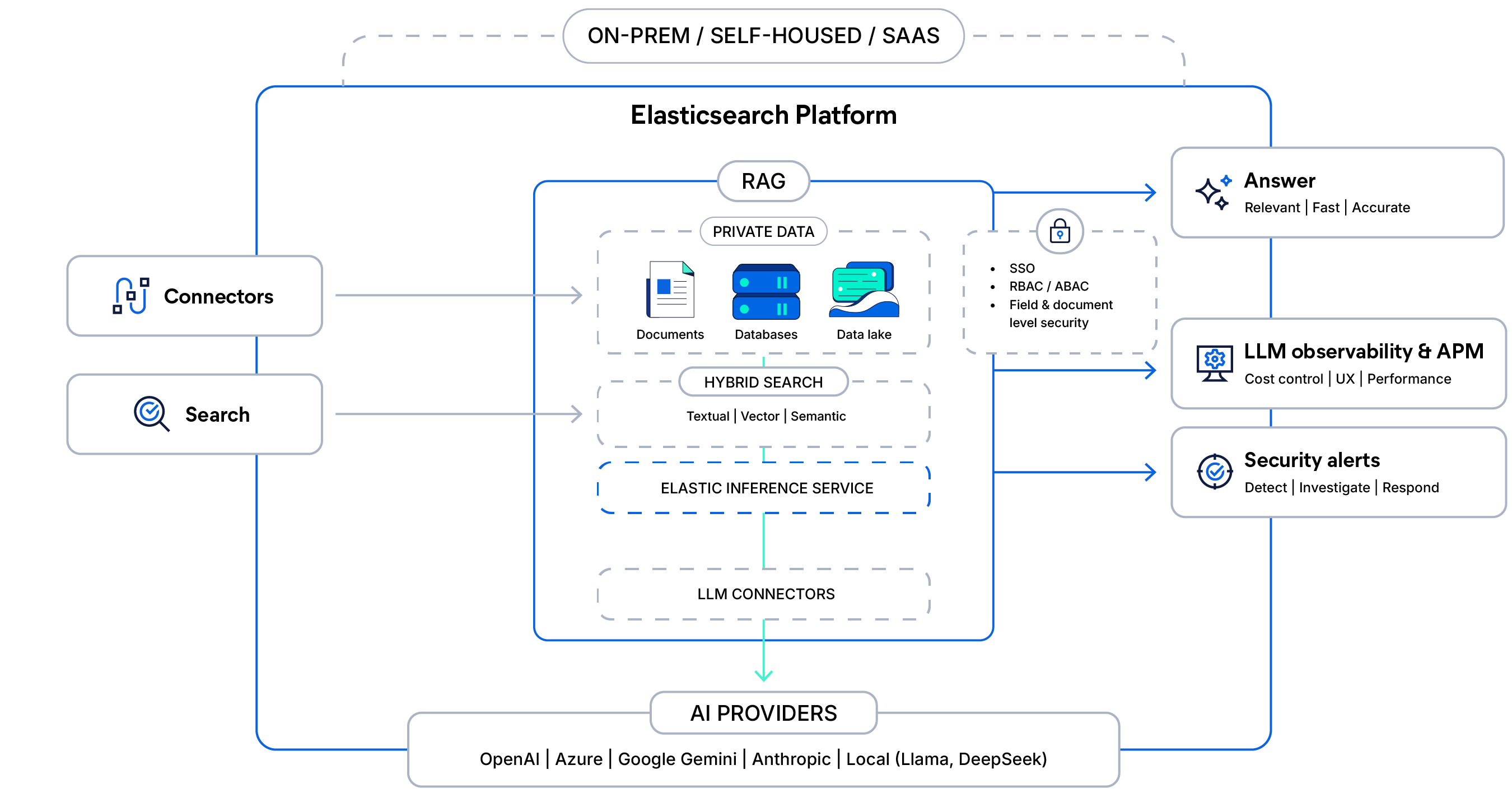

컨텍스트 인식 RAG의 아키텍처

개인 데이터를 안전한 하이브리드 검색 및 관리된 추론과 연결하고, 액세스 제어를 통해 LLM 응답을 기반으로 하며, 대규모로 빠르고 관찰 가능하며 실제 환경에서 사용 가능한 답변을 제공합니다.

무엇을 구축하고 계십니까?

데이터에 기반한 채팅과 컨텍스트에 따라 안내하는 에이전트를 구축하세요. 전체 훈련 카탈로그를 살펴보거나 Elasticsearch Labs의 튜토리얼을 따라하세요.

자주 묻는 질문

AI에서 RAG란 무엇입니까?

AI에서 RAG란 무엇입니까?

검색 증강 생성(일반적으로 RAG라고 함)은 기업이 독점 데이터 소스를 검색하고 대규모 언어 모델의 근거가 되는 컨텍스트를 제공할 수 있도록 하는 자연어 처리 패턴입니다.이를 통해 생성형 AI 애플리케이션에서 보다 정확한 실시간 응답이 가능합니다.

RAG의 이점은 무엇입니까?

RAG의 이점은 무엇입니까?

RAG를 최적으로 구현하면 관련 도메인별 독점 데이터에 실시간으로 안전하게 액세스할 수 있습니다.생성형 AI 애플리케이션에서 환각 발생률을 줄이고 response의 정밀도를 높일 수 있습니다.

RAG 워크플로우에 Elastic을 사용하면 어떤 이점이 있나요?

RAG 워크플로우에 Elastic을 사용하면 어떤 이점이 있나요?

Elastic은 고품질 데이터 수집 및 그라운딩, 대규모의 정확하고 효율적인 검색 제공, 역할 및 도큐먼트 수준 보안 적용, 신뢰할 수 있는 응답을 위한 소스 속성 보존 등 가장 어려운 부분을 즉시 해결하여 RAG를 실무에 투입 가능한 상태로 만듭니다. 기본 벡터, 어휘, 하이브리드 검색, ELSER와 같은 자체 모델, GenAI 생태계 전반의 유연한 서드파티 모델 통합, 엔터프라이즈 규모에서의 검증된 성능을 통해 Elastic은 팀들이 더 빠르게 출시하고, 조정하기 쉬우며, 프로덕션에서 신뢰할 수 있는 RAG 시스템을 구축할 수 있도록 지원합니다.

Elasticsearch는 어떻게 컨텍스트 엔지니어링을 가능하게 하나요?

Elasticsearch는 어떻게 컨텍스트 엔지니어링을 가능하게 하나요?

Elasticsearch는 대규모 확장 환경에서도 관련성을 유지하도록 설계되어 있으며, 이는 컨텍스트 엔지니어링의 기반이 됩니다. 단일 플랫폼에 벡터, 키워드, 정형 데이터 검색을 분석, 추론 및 가시성과 함께 통합하기 때문에 개발자가 정형화 및 비정형화 비즈니스 데이터를 정밀하게 저장, 검색 및 순위화할 수 있으며, 그 결과 에이전트는 항상 정확한 컨텍스트를 제공할 수 있습니다.

Elasticsearch는 Agent Builder를 통해 채팅, 검색, 도구 생성 및 오케스트레이션 기능을 플랫폼 내부로 직접 통합하여 기능을 확장합니다. 개발자는 자체 데이터, 모델 및 도구를 활용하여 몇 분 만에 컨텍스트 중심의 에이전트를 구축하고 테스트 및 확장할 수 있습니다. 이 모든 과정은 Elasticsearch의 관련성과 보안성 그리고 성능으로 지원됩니다.