Elastic et NVIDIA vous aident à déployer des applications d'IA plus rapidement sans surcharger votre infrastructure IT

Supprimez les goulots d'étranglement. Scalez plus intelligemment. Contrôlez les coûts. Avec Elastic et NVIDIA, vous bénéficiez de la puissance d'une base vectorielle accélérée par GPU pour une IA haute performance.

Pour aller plus loin

Libérez la puissance de l'IA grâce à la recherche vectorielle accélérée par GPU

Elasticsearch s'associe à NVIDIA pour intégrer la puissance des GPU à votre pile de recherche. Grâce à la bibliothèque cuVS et à l'algorithme CAGRA, Elasticsearch exploite un parallélisme massif pour offrir une indexation rapide et à très faible latence, idéale pour vos pipelines de génération augmentée par récupération (RAG) et vos applications d'IA les plus exigeantes.

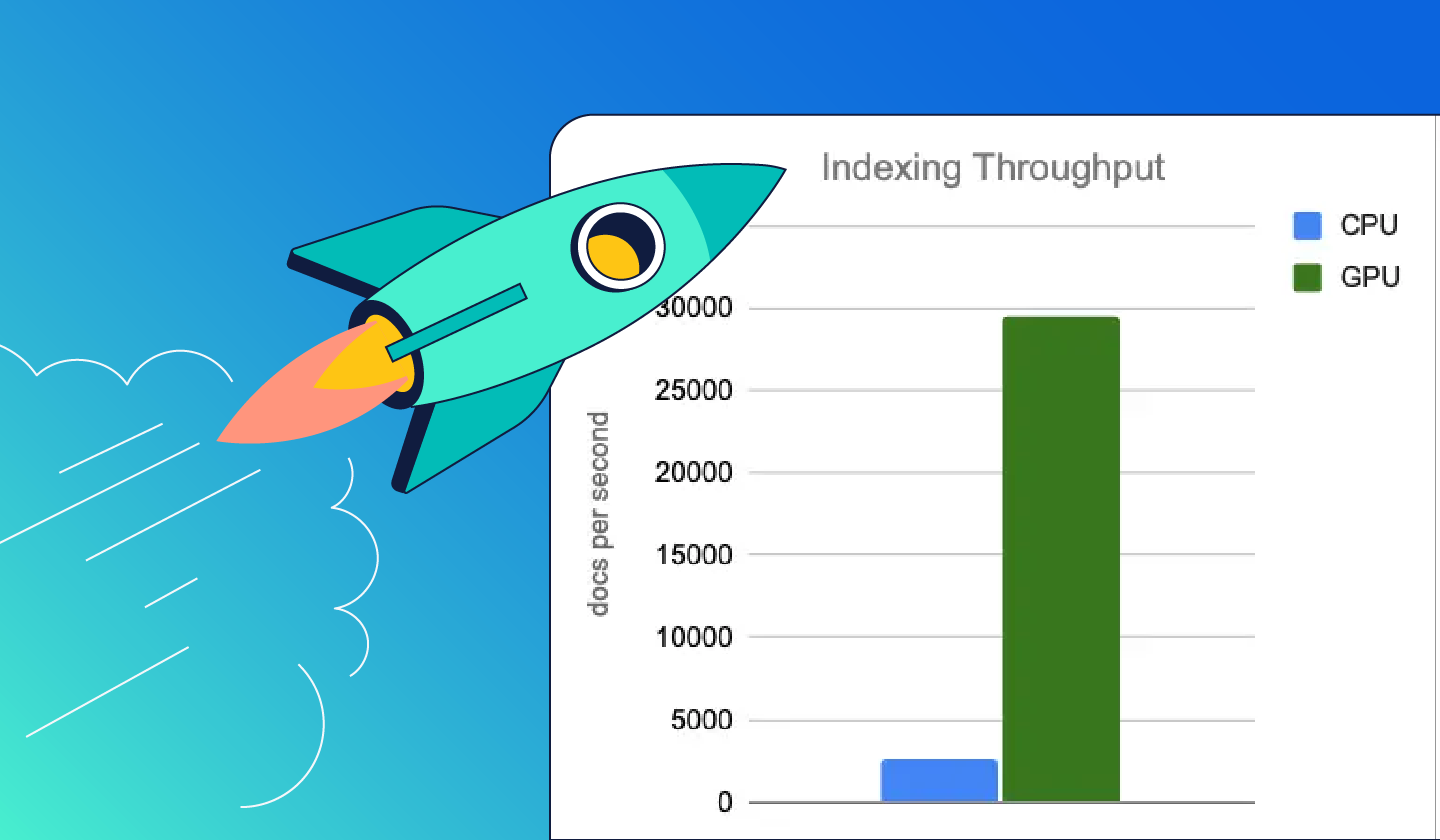

Adoptez l'indexation et la recherche sur GPU pour un débit et une rentabilité optimale. Optimisez à la fois les performances et les coûts.

Questions fréquentes

L'indexation vectorielle accélérée par GPU pour Elasticsearch est-elle disponible en open source ?

L'indexation vectorielle accélérée par GPU pour Elasticsearch est-elle disponible en open source ?

Oui, le code implémentant l'indexation vectorielle accélérée par GPU est open source (sous une double licence : AGPL et ELv2). Elasticsearch expose cette fonctionnalité via un plugin sous licence ELv2, disponible avec l'abonnement Entreprise. La bibliothèque NVIDIA cuVS, qui gère l'indexation sur GPU dans Elasticsearch, est également disponible en open source sous licence Apache 2.0.

Que dois-je faire si je rencontre des problèmes ou si j'ai des suggestions ?

Que dois-je faire si je rencontre des problèmes ou si j'ai des suggestions ?

En cas de problème, suivez nos instructions de dépannage. Si le problème persiste, créez un ticket d'assistance sur le GitHub d'Elasticsearch s'il s'agit d'un problème spécifique à Elasticsearch. Si le problème concerne NVIDIA cuVS et ses dépendances, créez un ticket sur le GitHub de NVIDIA cuVS. Si vous disposez d'un abonnement Entreprise, contactez-nous via les canaux de support technique client d'Elastic pour obtenir de l'aide. Utilisez ces mêmes canaux pour vos suggestions et demandes de fonctionnalités.

Comment installer NVIDIA cuVS sur un nœud de données Elasticsearch pour activer l'indexation vectorielle avec GPU ?

Comment installer NVIDIA cuVS sur un nœud de données Elasticsearch pour activer l'indexation vectorielle avec GPU ?

Vous pouvez installer NVIDIA cuVS en tant que package précompilé via l'archive tar disponible sur les canaux NVIDIA pour les utilisateurs de bases de données ou via les gestionnaires de packages pip ou conda pour les utilisateurs de science des données. Vous pouvez également compiler cuVS à partir des sources et gérer vous-même le binaire. Pour plus d'informations, consultez la page d'installation de NVIDIA cuVS. Pour les utilisateurs disposant d'un abonnement NVIDIA AI Enterprise (NVAIE) avec leurs GPU, une archive cuVS prenant en charge les correctifs CVE et accompagnée de garanties de support pour les CVE sera disponible dans quelques mois via le catalogue NGC. Contactez l'équipe de support NVAIE ou votre représentant commercial NVIDIA pour plus d'informations.

L'indexation vectorielle peut-elle scaler sur plusieurs GPU répartis sur un ou plusieurs serveurs ?

L'indexation vectorielle peut-elle scaler sur plusieurs GPU répartis sur un ou plusieurs serveurs ?

Oui, vous pouvez utiliser un système d'orchestration de conteneurs comme Kubernetes pour associer chaque processus Elasticsearch à un GPU disponible. Chaque processus Elasticsearch doit avoir l'usage exclusif d'un seul GPU. Le scaling pour utiliser plusieurs GPU se résume donc à scaler les nœuds dans le cluster.

La taille de l'index vectoriel est-elle limitée par la mémoire GPU disponible ?

La taille de l'index vectoriel est-elle limitée par la mémoire GPU disponible ?

Nous prenons en charge la création d'index plus volumineux que la mémoire GPU (également appelés index hors-cœur) en les générant par lots. Globalement, l'indexation GPU n'introduit aucune limitation supplémentaire par rapport à l'indexation sur processeur.

L'accélération GPU est-elle disponible pour la recherche vectorielle ?

L'accélération GPU est-elle disponible pour la recherche vectorielle ?

Non, seule la construction de l'index HNSW est actuellement accélérée par GPU. Le graphe HNSW qui en résulte est ensuite chargé dans la mémoire de l'hôte (processeur), et la recherche vectorielle s'effectue sur le processeur. Ce choix se justifie par l'immense avantage des GPU pour les opérations vectorielles en masse. L'extension future de l'utilisation des GPU sera envisagée en fonction de l'évolution de la technologie et des cas d'utilisation.

Comment évaluer les performances et les avantages en termes de coûts de l'indexation vectorielle sur GPU ?

Comment évaluer les performances et les avantages en termes de coûts de l'indexation vectorielle sur GPU ?

Vous pouvez utiliser l'outil Rally d'Elastic pour évaluer l'impact des GPU sur le débit d'indexation, la latence de fusion forcée, ainsi que la précision et la latence/le débit de recherche vectorielle. Consultez les instructions et les bonnes pratiques pour effectuer un benchmarking d'indexation vectorielle E2E sur des GPU via Rally.

Quels types d’éléments et d’index sont pris en charge ?

Quels types d’éléments et d’index sont pris en charge ?

Elasticsearch prend en charge plusieurs paramètres d'indexation différents. Les valeurs hnsw et int8_hnsw sont toutes deux prises en charge pour le paramètre index_options.type. Pour le paramètre element_type, seule les valeurs float sont acceptées. Pour l'instant, aucun autre type d'index ou d'élément n'est pris en charge.