Elastic과 NVIDIA는 IT 인프라에 부담을 주지 않으면서 AI 앱을 더 빠르게 배포하도록 지원합니다.

병목 현상은 해결하고 확장성은 높이면서 비용까지 효율적으로 관리하세요. Elastic과 NVIDIA를 통해 고성능 AI를 위한 GPU 가속 벡터 데이터베이스의 강력한 성능을 경험할 수 있습니다.

심층 자료

GPU 가속 벡터 검색으로 AI 성능 극대화하기

Elasticsearch가 NVIDIA와 협력하여 검색 스택에 GPU의 강력한 성능을 더했습니다. cuVS 라이브러리와 CAGRA 알고리즘을 활용하여 대규모 병렬 처리를 구현함으로써 Elasticsearch는 가장 까다로운 RAG(Retrieval-Augmented Generation) 파이프라인과 AI 애플리케이션에서도 빠르고 초저지연인 인덱싱 성능을 제공합니다.

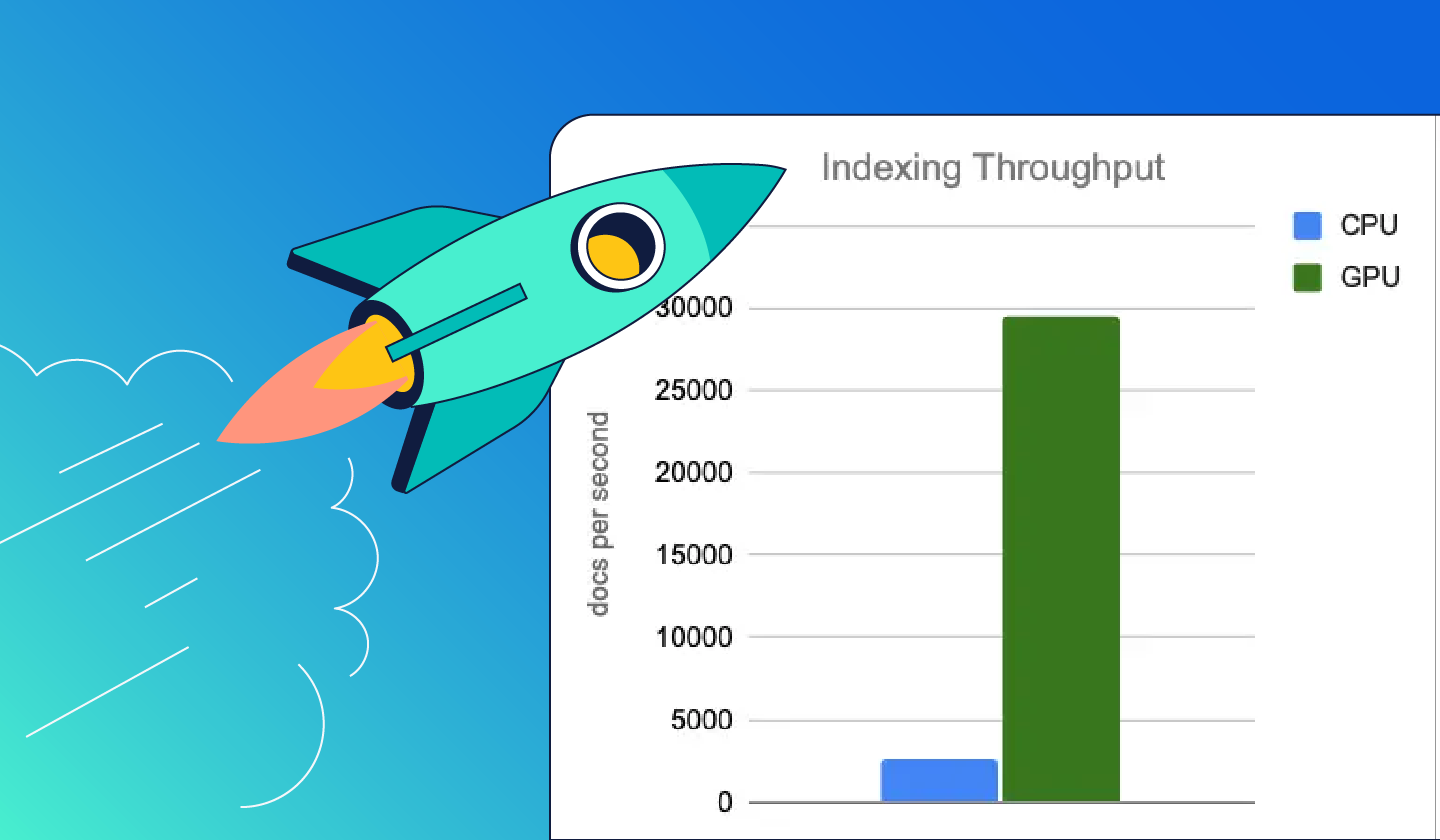

GPU로 인덱싱하여 처리량을 극대화하고 CPU로 검색하여 비용 효율성을 높여보세요. 성능과 비용, 두 가지 모두를 완벽하게 최적화할 수 있습니다.

자주 묻는 질문

Elasticsearch용 GPU 가속 벡터 인덱싱은 오픈 소스로 제공되나요?

Elasticsearch용 GPU 가속 벡터 인덱싱은 오픈 소스로 제공되나요?

네, GPU 가속 벡터 인덱싱을 구현하는 코드는 오픈 소스(AGPL 및 ELv2 이중 라이선스)로 제공됩니다. Elasticsearch는 ELv2 라이선스가 적용된 플러그인을 통해 GPU 가속 벡터 인덱싱 기능을 제공하며 이 플러그인은 엔터프라이즈 구독 등급에서 사용 가능합니다. Elasticsearch의 GPU 인덱싱 기능을 지원하는 라이브러리인 NVIDIA cuVS 또한 Apache 2.0 라이선스 하에 오픈 소스로 제공됩니다.

문제가 발생하거나 제안 사항이 있는 경우 어떻게 해야 하나요?

문제가 발생하거나 제안 사항이 있는 경우 어떻게 해야 하나요?

문제가 발생하면 문제 해결 지침을 확인해 보세요. 문제가 지속될 경우 Elasticsearch 관련 문제이면 Elasticsearch GitHub에 이슈를 생성해 주세요. 만약 NVIDIA cuVS 및 그 종속성과 관련된 문제라면 NVIDIA cuVS GitHub에 이슈를 올려 주시면 됩니다. 엔터프라이즈 구독을 이용 중이라면 Elastic 고객 지원 채널을 통해 해결 방안을 문의하실 수 있습니다. 제안 사항이나 기능 요청 또한 동일한 채널을 이용해 주세요.

Elasticsearch 데이터 노드에 NVIDIA cuVS를 설치해 GPU 벡터 인덱싱을 활성화하는 방법은 무엇인가요?

Elasticsearch 데이터 노드에 NVIDIA cuVS를 설치해 GPU 벡터 인덱싱을 활성화하는 방법은 무엇인가요?

데이터베이스 사용자는 NVIDIA 채널의 타볼 패키지를, 데이터 과학 사용자는 pip 또는 conda 패키지 관리자를 통해 NVIDIA cuVS를 사전 컴파일된 패키지 형태로 설치할 수 있습니다. 또한 cuVS를 소스에서 직접 빌드하여 바이너리를 유지 관리하는 방법도 있습니다. 자세한 내용은 NVIDIA cuVS 설치 페이지를 참고하세요. GPU와 함께 NVIDIA AI 엔터프라이즈(NVAIE) 구독을 이용 중인 사용자를 위해 CVE 수정 사항이 반영되고 CVE 관련 지원이 보장되는 cuVS 타볼이 몇 달 내로 NGC 카탈로그를 통해 제공될 예정입니다. 더 자세한 정보는 NVAIE 지원 팀이나 NVIDIA 영업 담당자에게 문의해 주세요.

벡터 인덱싱은 단일 서버나 여러 서버의 다중 GPU 환경에서도 확장할 수 있나요?

벡터 인덱싱은 단일 서버나 여러 서버의 다중 GPU 환경에서도 확장할 수 있나요?

네, Kubernetes와 같은 컨테이너 오케스트레이션 시스템을 사용하여 각 Elasticsearch 프로세스를 사용 가능한 GPU 하나에 매핑할 수 있습니다. Elasticsearch 프로세스 하나당 GPU 하나를 단독으로 사용하는 것이 좋습니다. 이런 방식으로 다중 GPU를 확장하는 것은 곧 클러스터 내 노드를 확장하는 것과 같습니다.

벡터 인덱스 크기가 사용 가능한 GPU 메모리에 제한을 받나요?

벡터 인덱스 크기가 사용 가능한 GPU 메모리에 제한을 받나요?

배치 단위로 인덱스를 구축하여 GPU 메모리 용량보다 큰 인덱스(일명 'Out-of-core' 방식)도 지원합니다. 전반적으로 GPU 인덱싱은 기존 CPU 기반 인덱싱에서 발생하는 제약 외에 별도의 추가적인 제한은 없습니다.

벡터 검색에 GPU 가속을 사용할 수 있나요?

벡터 검색에 GPU 가속을 사용할 수 있나요?

아니요, 현재는 HNSW 인덱스 생성에만 GPU 가속이 적용됩니다. 생성된 HNSW 그래프는 호스트(CPU) 메모리로 로드되며 벡터 검색은 CPU에서 수행됩니다. 이렇게 결정한 이유는 대량의 벡터 연산에서 GPU가 갖는 압도적인 이점 때문입니다. 향후 기술과 사용 사례 발전에 따라 GPU 활용 범위를 더 넓히는 방안을 검토할 예정입니다.

GPU 벡터 인덱싱의 성능과 비용 효율은 어떻게 평가하나요?

GPU 벡터 인덱싱의 성능과 비용 효율은 어떻게 평가하나요?

Elastic의 Rally 도구를 사용해 GPU가 인덱싱 처리량, 강제 병합 지연 시간, 벡터 검색 정확도, 지연 시간/처리량 등에 미치는 영향을 평가할 수 있습니다. Rally를 통해 GPU 기반의 엔드투엔드 벡터 인덱싱 벤치마킹을 실행하는 지침과 모범 사례를 확인해 보세요.

지원하는 요소 및 인덱스 유형은 무엇인가요?

지원하는 요소 및 인덱스 유형은 무엇인가요?

Elasticsearch는 다양한 인덱싱 매개변수를 지원합니다. index_options.type 매개변수에는 hnsw 및 int8_hnsw 값을 모두 사용할 수 있습니다. element_type의 경우 float만 지원하며 현재는 그 외의 다른 인덱스 및 요소 유형은 지원하지 않습니다.