Elastic & NVIDIA: KI-Apps schneller bereitstellen, ohne die IT-Infrastruktur zu belasten

Beseitigen Sie Engpässe. Skalieren Sie klüger. Kontrollieren Sie die Kosten. Mit Elastic und NVIDIA erhalten Sie die Leistung einer GPU-beschleunigten Vektordatenbank für Hochleistungs-KI.

Sie möchten mehr wissen?

Entfesseln Sie die KI-Leistung mit GPU-beschleunigter Vektorsuche

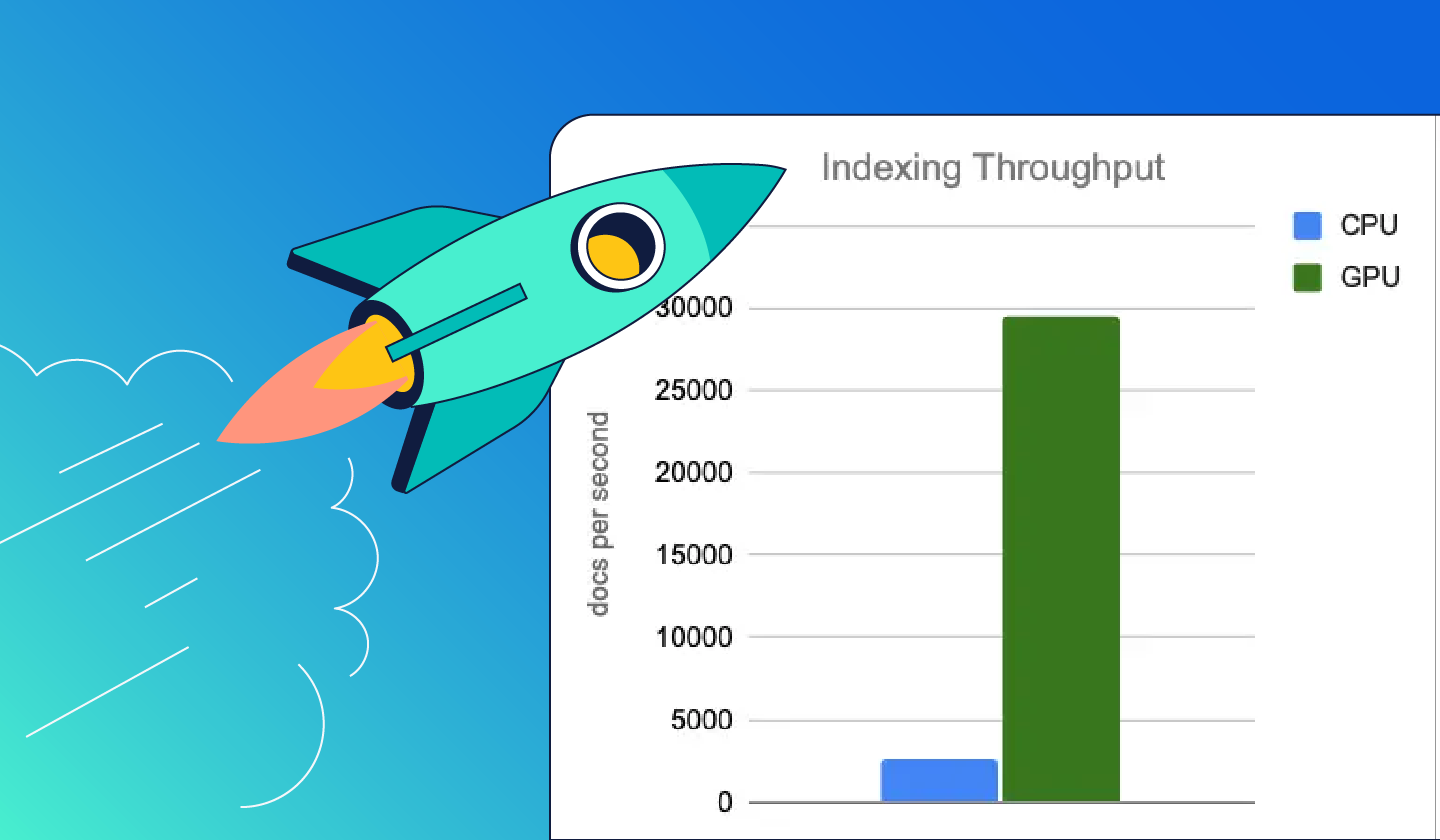

Elasticsearch arbeitet mit NVIDIA zusammen, um die GPU-Leistung in Ihre Sucharchitektur zu bringen. Durch die Nutzung der cuVS-Bibliothek und des CAGRA-Algorithmus hat Elasticsearch massive Parallelität freigesetzt, um eine schnelle und extrem latenzarme Indizierung für Ihre anspruchsvollsten Retrieval Augmented Generation (RAG)-Pipelines und KI-Anwendungen zu ermöglichen.

Indexieren Sie auf GPUs für maximalen Durchsatz. Suchen Sie auf CPUs für Kosteneffizienz. Optimieren Sie sowohl Leistung als auch Preis.

Häufig gestellte Fragen

Ist GPU-beschleunigte Vektor-Indexierung für Elasticsearch als Open Source verfügbar?

Ist GPU-beschleunigte Vektor-Indexierung für Elasticsearch als Open Source verfügbar?

Ja, der Code für die GPU-beschleunigte Vektor-Indexierung ist Open Source (unter einer Doppellizenz: AGPL und ELv2). Elasticsearch stellt das GPU-beschleunigte Vektor-Indexierungs-Feature über ein Plugin bereit, das unter der ELv2-Lizenz lizenziert und im Enterprise-Abonnement verfügbar ist. NVIDIA cuVS, die Bibliothek, die die GPU-Indexierungs-Features in Elasticsearch ermöglicht, ist ebenfalls als Open Source unter der Apache-2.0-Lizenz verfügbar.

Was soll ich tun, wenn ich auf Probleme stoße oder Vorschläge habe?

Was soll ich tun, wenn ich auf Probleme stoße oder Vorschläge habe?

Falls es Probleme gibt, probieren Sie unsere Fehlerbehebungsanweisungen. Wenn Ihr Problem weiterhin besteht, erstellen Sie ein Problem auf Elasticsearch GitHub, falls es ein spezifisches Elasticsearch-Problem ist. Wenn das Problem NVIDIA cuVS und seine Abhängigkeiten betrifft, eröffnen Sie ein Problem auf dem NVIDIA cuVS GitHub. Wenn Sie ein Enterprise-Abonnement haben, kontaktieren Sie uns über die Elastic-Kundensupport-Kanäle, um eine Lösung zu erhalten. Nutzen Sie dieselben Kanäle für Vorschläge und Feature-Anfragen.

Wie installiere ich NVIDIA cuVS auf einem Elasticsearch-Daten-Node, um die GPU-Vektor-Indexierung zu ermöglichen?

Wie installiere ich NVIDIA cuVS auf einem Elasticsearch-Daten-Node, um die GPU-Vektor-Indexierung zu ermöglichen?

Sie können NVIDIA cuVS als vorkompiliertes Paket über Tarball von NVIDIA-Kanälen für Datenbanknutzer oder über pip- oder conda-Paketmanager für Data-Science-Nutzer installieren. Sie können cuVS auch aus dem Quellcode erstellen und das Binärpaket selbst pflegen. Weitere Informationen finden Sie auf der NVIDIA cuVS-Installationsseite. Für Nutzer mit einem NVIDIA KI Enterprise (NVAIE)-Abonnement mit Ihren GPUs wird ein CVE-Fix-unterstützter cuVS-Tarball mit Supportgarantien für CVEs in einigen Monaten über den NGC-Katalog verfügbar sein. Wenden Sie sich für weitere Informationen an das NVAIE-Supportteam oder Ihren NVIDIA-Vertriebsmitarbeiter.

Kann die Vektorindizierung über mehrere GPUs auf einem oder mehreren Servern skaliert werden?

Kann die Vektorindizierung über mehrere GPUs auf einem oder mehreren Servern skaliert werden?

Ja, Sie können ein Container-Orchestrierungssystem wie Kubernetes verwenden, um jeden Elasticsearch-Prozess einer verfügbaren GPU zuzuordnen. Jeder Elasticsearch-Prozess sollte exklusiv eine einzelne GPU nutzen. Dadurch entspricht die Skalierung auf mehrere GPUs der Skalierung von Knoten im Cluster.

Ist die Größe des Vektorindex durch den verfügbaren GPU-Speicher begrenzt?

Ist die Größe des Vektorindex durch den verfügbaren GPU-Speicher begrenzt?

Wir unterstützen den Aufbau von Indizes, die größer sind als der GPU-Speicher (auch bekannt als Out-of-Core), indem wir sie in Batches erstellen. Insgesamt bringt die GPU-Indexierung keine zusätzlichen Einschränkungen mit sich, die über die bereits vorhandenen CPU-basierten Indexierungen hinausgehen.

Ist GPU-Beschleunigung für die Vektorsuche verfügbar?

Ist GPU-Beschleunigung für die Vektorsuche verfügbar?

Nein, nur die Konstruktion des HNSW-Indexes ist heute GPU-beschleunigt. Der resultierende HNSW-Graph wird dann in den Host-(CPU-)Speicher geladen, und der Vektorabruf läuft auf der CPU. Die Begründung für diese Entscheidung ist der enorme Vorteil, den GPUs bei Massenvektoroperationen haben. Eine weitere Ausweitung der GPU-Nutzung wird in Betracht gezogen, wenn sich die Technologie und die Anwendungsfälle weiterentwickeln.

Wie bewerte ich die Leistung und die Kostenvorteile der GPU-Vektorindexierung?

Wie bewerte ich die Leistung und die Kostenvorteile der GPU-Vektorindexierung?

Sie können das Rally-Tool von Elastic verwenden, um die Auswirkungen von GPUs auf den Indexdurchsatz, die Merge-Latenz sowie die Genauigkeit und Latenz/Durchsatz der Vektorsuche zu bewerten. Sehen Sie sich Anweisungen und Best Practices an, um E2e-Vektor-Indexierungs-Benchmarking auf GPUs über Rally auszuführen.

Welche Element- und Indextypen werden unterstützt?

Welche Element- und Indextypen werden unterstützt?

Elasticsearch unterstützt mehrere verschiedene Indexierparameter. Sowohl der hnsw- als auch der int8_hnsw-Wert werden für den Parameter index_options.type unterstützt. Für den element_type wird nur float unterstützt. Derzeit werden keine weiteren Index- und Elementtypen unterstützt.