Elastic 和 NVIDIA 可帮助您更快部署 AI 应用,避免过度消耗 IT 基础设施

消除瓶颈、智能扩展、控制成本。借助 Elastic 和 NVIDIA 的支持,您可利用 GPU 加速向量数据库的强大功能,实现高性能 AI。

通过 GPU 加速的向量搜索提升 AI 性能

Elasticsearch 与 NVIDIA 合作,将 GPU 支持引入您的搜索堆栈。通过利用 cuVS 库和 CAGRA 算法,Elasticsearch 已经解锁了大规模并行处理,为需求最苛刻的检索增强生成 (RAG) 管道和 AI 应用程序提供快速和超低延迟索引。

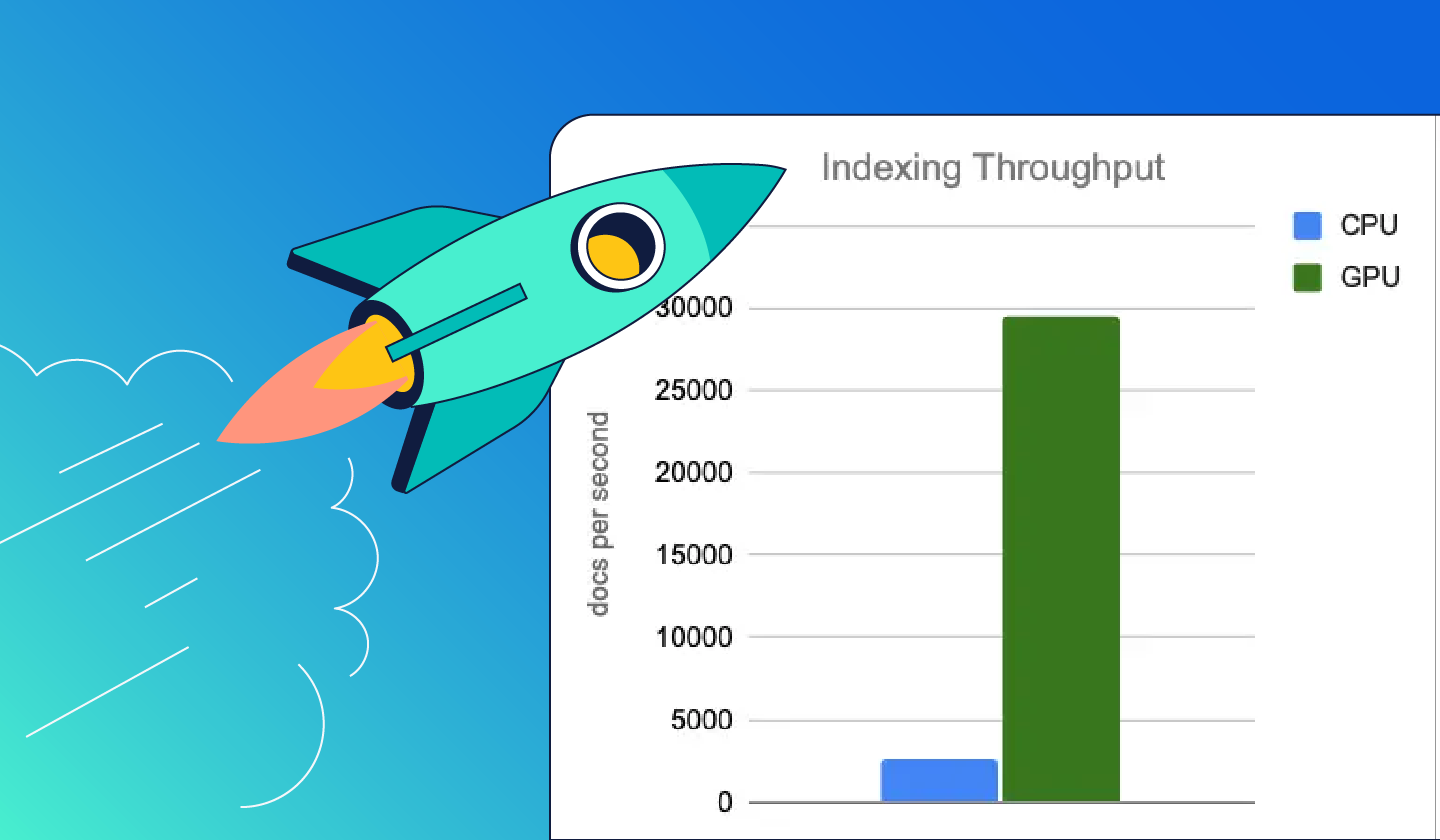

使用 GPU 进行索引可以获得最大吞吐量。在 CPU 上搜索可以实现成本效益。性能和价格可以同时得到优化。

常见问题

Elasticsearch 的 GPU 加速向量索引功能是否已开源?

Elasticsearch 的 GPU 加速向量索引功能是否已开源?

是的,实现 GPU 加速向量索引的代码是开源的(双重许可:AGPL 和 ELv2)。Elasticsearch 通过一个插件公开 GPU 加速向量索引功能,该插件在 ELv2 许可下发布,并在企业订阅层级提供。为 Elasticsearch 提供 GPU 索引功能的 NVIDIA cuVS 库也是开源的,采用 Apache 2.0 许可。

如果遇到问题或想要提出建议,应该怎么做?

如果遇到问题或想要提出建议,应该怎么做?

如果出现任何问题,请查看我们的故障排除说明尝试解决。如果问题仍然存在,如果是 Elasticsearch 相关问题,请在 Elasticsearch GitHub 上创建一个问题。如果问题与 NVIDIA cuVS 及其依赖关系有关,请在 NVIDIA cuVS GitHub 上创建问题。如果您有企业订阅,请通过 Elastic 客户支持渠道联系我们寻求解决方案。您可以使用相同的渠道提出建议和请求功能。

如何在 Elasticsearch 数据节点上安装 NVIDIA cuVS 以启用 GPU 向量索引?

如何在 Elasticsearch 数据节点上安装 NVIDIA cuVS 以启用 GPU 向量索引?

您可以通过 tarball 从 NVIDIA 渠道为数据库用户安装预编译的 NVIDIA cuVS 包,或通过 pip 或 conda 包管理器 为数据科学用户安装。您也可以从源代码构建 cuVS 并自行维护二进制文件。有关更多信息,请参阅 NVIDIA cuVS 安装页面。对于拥有 NVIDIA AI Enterprise (NVAIE) 订阅的 GPU 用户,支持 CVE 修复的 cuVS tarball 将在几个月内通过 NGC 目录 提供,并附有 CVE 支持保证。请联系 NVAIE 支持团队或您的 NVIDIA 销售代表以获取更多信息。

向量索引能否跨一台或多台服务器上的多个 GPU 进行扩展?

向量索引能否跨一台或多台服务器上的多个 GPU 进行扩展?

可以,您可以使用像 Kubernetes 这样的容器编排系统,将每个 Elasticsearch 进程映射到一个可用的 GPU。单个 Elasticsearch 进程应独占使用单个 GPU。这样,扩展到使用多个 GPU 就相当于扩展集群中的节点。

向量索引大小是否受可用 GPU 内存的限制?

向量索引大小是否受可用 GPU 内存的限制?

我们支持通过分批构建索引来构建大于 GPU 内存(即核外索引)的索引。总体而言,GPU 索引不会引入任何超出 CPU 索引现有限制的额外限制。

向量搜索是否可以使用 GPU 加速?

向量搜索是否可以使用 GPU 加速?

不可以,目前只有 HNSW 索引构建使用了 GPU 加速。随后,生成的 HNSW 图将被加载到主机 (CPU) 内存中,向量检索也在 CPU 上运行。做出这一决定的原因是 GPU 在批量向量操作方面具有巨大优势。随着技术和用例的发展,我们将考虑进一步扩大 GPU 的使用范围。

如何评估 GPU 向量索引的性能和成本效益?

如何评估 GPU 向量索引的性能和成本效益?

您可以使用 Elastic 的 Rally 工具来评估 GPU 对索引吞吐量、强制合并延迟以及向量搜索精度和延迟/吞吐量的影响。查看说明和最佳实践,通过 Rally 在 GPU 上运行端到端向量索引基准测试。

支持哪些元素和索引类型?

支持哪些元素和索引类型?

Elasticsearch 支持多种不同的索引参数。index_options.type 参数支持 hnsw 和 int8_hnsw 值。element_type 中只支持 float。目前不支持其他索引和元素类型。