Elastic y NVIDIA te permiten implementar aplicaciones de IA más rápido sin agotar la infraestructura de TI

Elimina los cuellos de botella. Escala de forma más inteligente. Controla los costos. Con Elastic y NVIDIA, obtienes el poder de una base de datos vectorial acelerada por GPU para una IA de alto rendimiento.

Análisis más a fondo

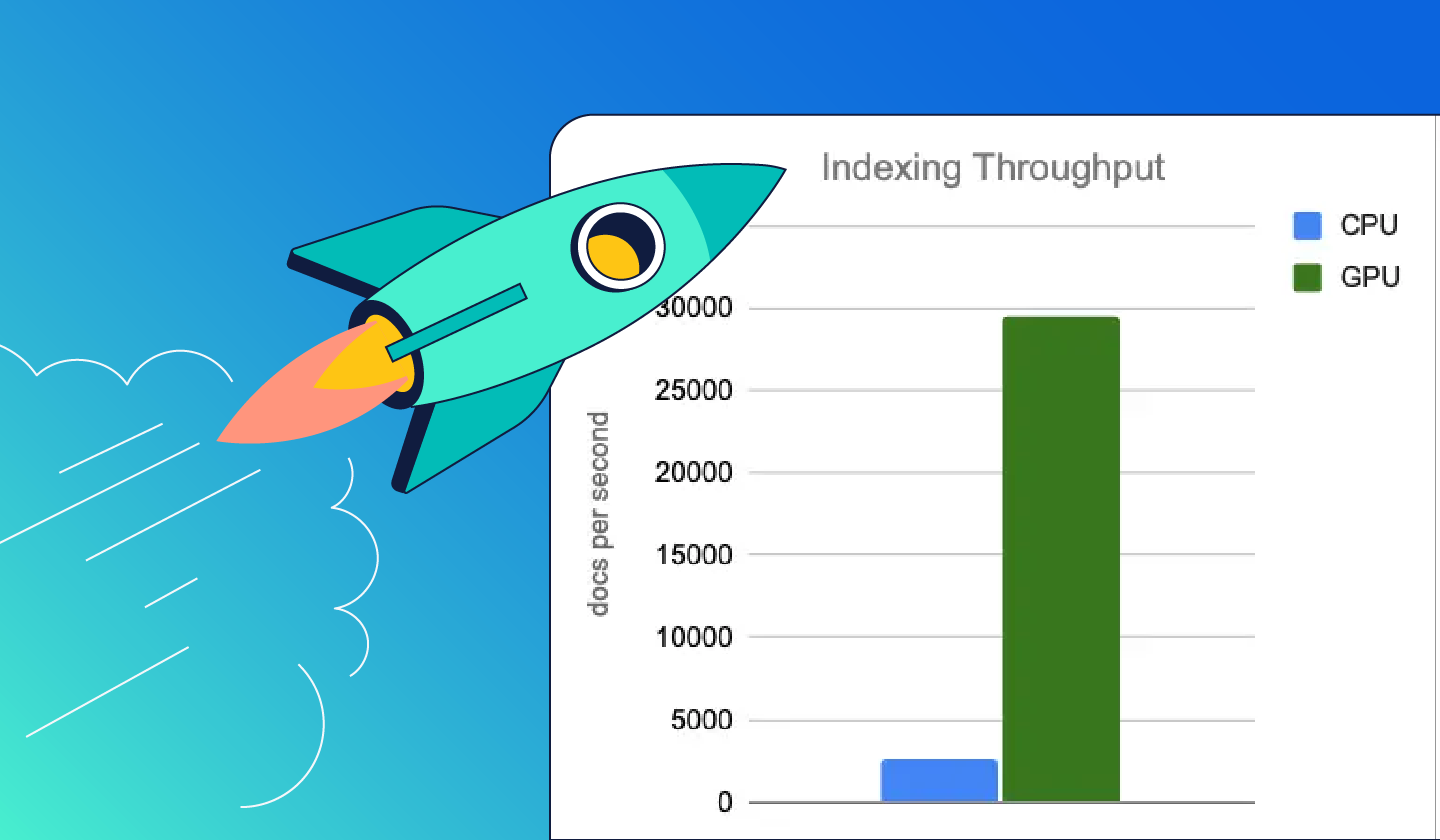

Libera el rendimiento de la IA con la búsqueda vectorial acelerada por GPU

Elasticsearch se ha asociado con NVIDIA para llevar el poder de la GPU a tu pila de búsqueda. Al aprovechar la biblioteca cuVS y el algoritmo CAGRA, Elasticsearch ha desbloqueado un paralelismo masivo para ofrecer un indexado rápido y con una latencia ultrabaja para tus pipelines de Retrieval-Augmented Generation (RAG) y aplicaciones de IA más exigentes.

Indexa en GPU para el máximo rendimiento. Haz una búsqueda en CPU para obtener rentabilidad. Optimiza tanto el rendimiento como el precio.

Preguntas frecuentes

¿La indexación vectorial acelerada por GPU para Elasticsearch está disponible como open source?

¿La indexación vectorial acelerada por GPU para Elasticsearch está disponible como open source?

Sí, el código que implementa la indexación de vectores acelerada por GPU es open source (bajo una licencia dual: AGPL y ELv2). Elasticsearch expone la funcionalidad de indexación de vectores acelerada por GPU a través de un plugin que está licenciado bajo la licencia ELv2 y está disponible en el nivel de suscripción Empresarial. NVIDIA cuVS, la biblioteca que impulsa las características de indexación de GPU en Elasticsearch, también está disponible como open source bajo la licencia Apache 2.0.

¿Qué debo hacer si tengo problemas o sugerencias?

¿Qué debo hacer si tengo problemas o sugerencias?

Si tienes algún problema, consulta nuestras instrucciones de solución de problemas. Si el problema persiste, crea una incidencia en el GitHub de Elasticsearch si se trata de un problema específico de Elasticsearch. Si el problema se refiere a NVIDIA cuVS y sus dependencias, abre una incidencia en el GitHub de NVIDIA cuVS. Si tienes una suscripción Empresarial, contáctanos a través de los canales de atención al cliente de Elastic para obtener una solución. Emplea los mismos canales para sugerencias y solicitudes de características.

¿Cómo instalas NVIDIA cuVS en un nodo de datos de Elasticsearch para habilitar la indexación vectorial por GPU?

¿Cómo instalas NVIDIA cuVS en un nodo de datos de Elasticsearch para habilitar la indexación vectorial por GPU?

Puedes instalar NVIDIA cuVS como paquete precompilado mediante un tarball desde los canales de NVIDIA para usuarios de bases de datos o mediante los gestores de paquetes pip o conda para usuarios de ciencia de datos. También puedes compilar cuVS desde el código fuente y mantener el binario por ti mismo. Para obtener más información, consulta la página de instalación de NVIDIA cuVS. Para usuarios con suscripción a NVIDIA AI Empresarial (NVAIE) con tus GPU, el tarball de cuVS compatible con correcciones de CVE y garantías de compatibilidad estará disponible a través del catálogo de NGC en unos meses. Para obtener más información, ponte en contacto con el equipo de soporte de NVAIE o con tu representante de ventas de NVIDIA.

¿Puede la indexación vectorial escalar entre varias GPU en uno o varios servidores?

¿Puede la indexación vectorial escalar entre varias GPU en uno o varios servidores?

Sí, puedes usar un sistema de orquestación de contenedores como Kubernetes para asignar cada proceso de Elasticsearch a una GPU disponible. Un solo proceso de Elasticsearch debería tener uso exclusivo de una sola GPU. De esta manera, el escalado para usar varias GPU se convierte en el escalado de nodos en el clúster.

¿El tamaño del índice de vectores está limitado por la memoria disponible de la GPU?

¿El tamaño del índice de vectores está limitado por la memoria disponible de la GPU?

Permitimos la construcción de índices que son mayores que la memoria GPU (es decir, fuera de núcleo) construyéndolos por lotes. En general, la indexación por GPU no introduce limitaciones adicionales más allá de las ya presentes con la indexación basada en CPU.

¿Está disponible la aceleración de GPU para la búsqueda vectorial?

¿Está disponible la aceleración de GPU para la búsqueda vectorial?

No, actualmente solo la construcción de índices HNSW se acelera mediante GPU. El grafo HNSW resultante se carga en la memoria del host (CPU) y la recuperación de vectores se ejecuta en la CPU. Esta decisión se basa en el gran beneficio que ofrecen las GPU en las operaciones vectoriales masivas. Se considerará ampliar el uso de la GPU a medida que la tecnología y los casos de uso evolucionen.

¿Cómo puedo evaluar el rendimiento y los beneficios de costos de la indexación vectorial de GPU?

¿Cómo puedo evaluar el rendimiento y los beneficios de costos de la indexación vectorial de GPU?

Puedes usar la herramienta Rally de Elastic para evaluar el impacto de las GPU en el rendimiento de indexación, la latencia de fusión forzada y la precisión, latencia y rendimiento de la búsqueda vectorial. Consulta las instrucciones y mejores prácticas para ejecutar la evaluación de rendimiento de indexación vectorial de extremo a extremo en GPU a través de Rally.

¿Qué tipos de elementos e índices son compatibles?

¿Qué tipos de elementos e índices son compatibles?

Elasticsearch admite varios parámetros de indexación diferentes. Se admiten tanto hnsw como int8_hnsw para el parámetro index_options.type. Para el element_type, solo se admite float. Por ahora, no se admiten otros tipos de índice ni de elementos.