Desde la búsqueda vectorial hasta las potentes API REST, Elasticsearch ofrece a los desarrolladores el conjunto de herramientas de búsqueda más completo. Explora nuestros cuadernos de muestra en el repositorio de Elasticsearch Labs para probar algo nuevo. También puedes iniciar tu prueba gratuita o ejecutar Elasticsearch localmente hoy mismo.

Elastic se complace en anunciar que la base de datos vectorial de Elasticsearch ahora está integrada en la plataforma Vertex AI de Google Cloud como un motor de recuperación de información compatible de forma nativa, lo que permite a los usuarios aprovechar las fortalezas multimodales de los modelos Gemini de Google con las capacidades avanzadas de búsqueda semántica e híbrida impulsadas por IA de Elasticsearch.

Los desarrolladores ahora pueden crear sus aplicaciones RAG dentro de un viaje unificado, basando sus experiencias de chat en sus datos privados de una forma flexible y low-code. Ya sea que estés construyendo agentes de IA para tus clientes y empleados internos o aprovechando la generación de LLMs dentro de tu software, la plataforma Vertex AI pone la relevancia de Elasticsearch al alcance de tus dedos con una configuración mínima. Esta integración permite una adopción más fácil y rápida de los modelos Gemini en casos de uso de producción, impulsando la GenAI de PoCs a escenarios reales.

En este blog, te guiaremos a través de la integración de Elasticsearch con la plataforma Vertex AI de Google Cloud para una base de datos fluida y la creación de aplicaciones GenAI totalmente personalizables. Descubramos cómo.

Los modelos Vertex AI y Gemini de Google Cloud están basados en tus datos con Elasticsearch

Los usuarios que aprovechan los servicios y herramientas de Vertex AI para crear aplicaciones GenAI ahora pueden acceder a la nueva opción "Grounding" para incorporar sus datos privados a su interacción conversacional automáticamente. Elasticsearch ahora es parte de esta característica y se puede usar a través de:

- API de Vertex AI LLM, que enriquecen directamente los modelos Gemini de Google en el momento de la generación (preferido);

- Grounded Generation, que se usa en su lugar en el ecosistema de Vertex AI Agent Builder para crear experiencias agenciales.

Con esta integración, Elasticsearch, la base de datos vectorial más descargada e implementada, llevará tus datos empresariales relevantes donde sea necesario en tus chats internos de cara al cliente final, lo cual es crucial para la adopción de GenAI en los procesos de negocio en la vida real.

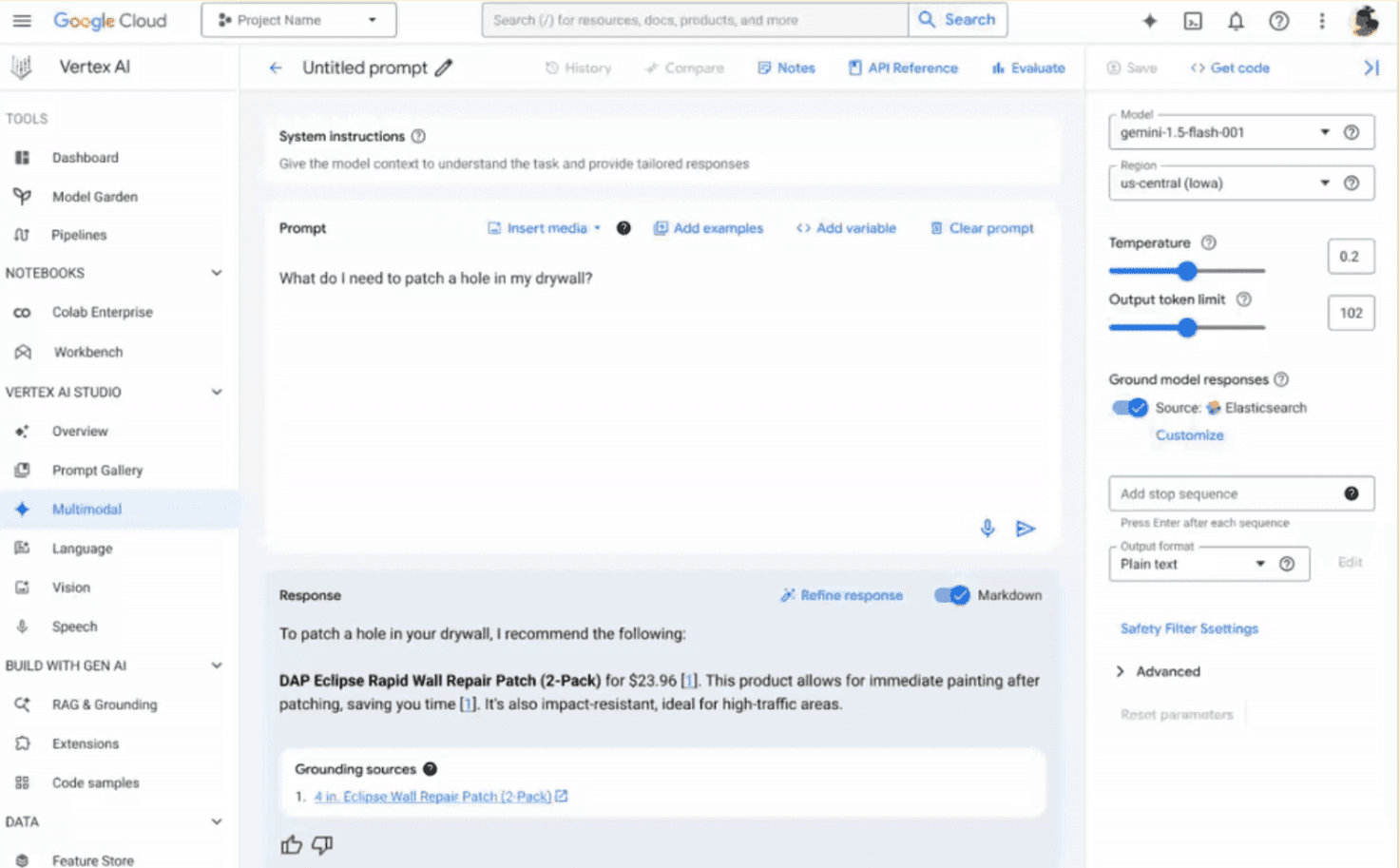

Las API mencionadas permitirán a los desarrolladores adoptar esta nueva característica asociada en su código. Sin embargo, la ingeniería y las pruebas rápidas siguen siendo pasos cruciales en el desarrollo de aplicaciones y sirven como un campo de descubrimiento inicial. Para respaldar esto, Elasticsearch está diseñado para que los usuarios puedan evaluarlo fácilmente dentro de la herramienta de consola Vertex AI Studio.

Todo lo que se necesita son unos simples pasos para configurar los puntos finales de Elastic con los parámetros deseados (índice a buscar, la cantidad de documentos a recuperar y la plantilla de búsqueda deseada) dentro de la pestaña "Personalizar conexión a tierra" en la interfaz de usuario, como se muestra a continuación (tenga en cuenta que para que funcione, debe escribir la clave API con la palabra "ApiKey" en la interfaz de usuario y los ejemplos de código a continuación). ¡Ahora estás listo para generar con tu conocimiento privado!

Aplicaciones GenAI listas para producción con facilidad

Elastic y Google Cloud trabajan para proporcionar experiencias integrales, agradables y que priorizan a los desarrolladores. La conexión a Elastic de forma nativa tanto en LLM como en la API de generación de conexión a tierra reduce la complejidad y la sobrecarga al crear aplicaciones GAI en Vertex AI, lo que evita API adicionales innecesarias y la orquestación de datos mientras se basa en una sola llamada unificada.

Veamos cómo funciona en ambos escenarios.

El primer ejemplo se ejecuta con la API de LLM:

En el ejemplo anterior, con el campo retrieval de la API que aplicar la generación de contenido a Gemini 2.0 Flash, podemos configurar contextualmente un motor de recuperación para la solicitud. Establecer api_spec en "ELASTIC_SEARCH" permite el uso de parámetros de configuración adicionales, como la clave de API y el punto de enlace del clúster (necesarios para enrutar una solicitud a tu clúster de Elastic), el índice del que recuperar datos y la plantilla de búsqueda que se empleará para tu lógica de búsqueda.

Del mismo modo, se podría lograr el mismo resultado con la API de generación de puesta a tierra, estableciendo el parámetro groundingSpec :

Con ambos enfoques, la respuesta proporcionará una respuesta con los documentos privados más relevantes que se encuentran en Elasticsearch, y las fuentes de datos conectadas relacionadas, para respaldar tu consulta.

Sin embargo, la simplicidad no debe confundir con la falta de personalización para satisfacer sus necesidades y casos de uso específicos. Con esto en mente, lo diseñamos para permitirle adaptar perfectamente la configuración de búsqueda a su escenario.

Búsqueda totalmente personalizable al alcance de tu mano: plantillas de búsqueda

Para proporcionar la máxima personalización a tu escenario de búsqueda, creamos, en colaboración con Google Cloud, la experiencia sobre nuestras conocidas plantillas de búsqueda. Las plantillas de búsqueda de Elasticsearch son una excelente herramienta para crear consultas de búsqueda dinámicas, reutilizables y mantenibles. Permiten predefinir y reutilizar estructuras de consulta. Son particularmente útiles cuando se ejecutan consultas similares con diferentes parámetros, ya que ahorran tiempo de desarrollo y reducen la posibilidad de errores. Las plantillas pueden incluir marcadores de posición para variables, lo que hace que las consultas sean dinámicas y adaptables a diferentes requisitos de búsqueda.

Al usar las API de Vertex AI y Elasticsearch para la conexión a tierra, debes hacer referencia a una plantilla de búsqueda deseada, como se muestra en los fragmentos de código anteriores, donde se implementa la lógica de búsqueda y se envía a Elasticsearch. Los usuarios avanzados de Elastic pueden gestionar, configurar y actualizar de forma asíncrona los enfoques de búsqueda y adaptarlos a los índices, modelos y datos específicos de una manera totalmente transparente para los usuarios de Vertex AI, los desarrolladores de aplicaciones sitio web o los ingenieros de IA, que solo necesitan especificar el nombre de la plantilla en la API de fundamentación.

Este diseño permite una personalización completa, poniendo a tu disposición las amplias funciones de recuperación de Elasticsearch en un entorno de IA de Google Cloud, al tiempo que garantiza la modularidad, la transparencia y la facilidad de uso para diferentes desarrolladores, incluso aquellos que no están familiarizados con Elastic.

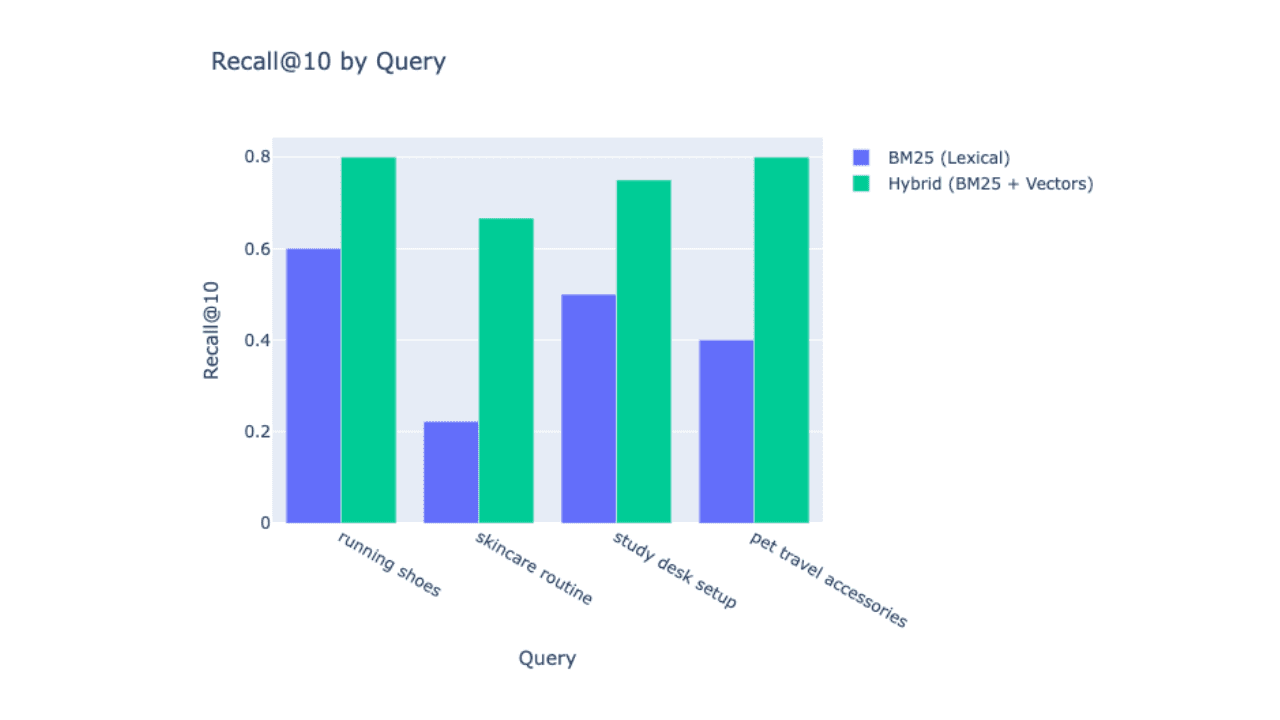

Siempre que necesite la búsqueda BM25, la búsqueda semántica o un enfoque híbrido entre los dos (¿Ya exploró los retrievers ? Técnicas de recuperación componibles en una sola llamada a la API de búsqueda), puedes definir tu lógica personalizada en una plantilla de búsqueda, que Vertex AI puede aprovechar automáticamente.

Esto también se aplica a las incrustaciones y reclasificaciones de modelos que elija para gestionar vectores y resultados. Según tu caso de uso, es posible que desees alojar modelos en los nodos de ML de Elastic, usar un endpoint de servicio de terceros a través de la API de inferencia o ejecutar tu modelo local en las instalaciones. Esto se puede hacer a través de una plantilla de búsqueda, y veremos cómo funciona en la siguiente sección.

Comience con plantillas de referencia y luego cree las suyas propias

Para ayudarlo a empezar rápidamente, proporcionamos un conjunto de ejemplos de plantillas de búsqueda compatibles que se emplearán como referencia inicial; Luego puede modificar y construir sus personalizados sobre:

- Búsqueda semántica con modelo ELSER (vectores dispersos y fragmentación)

- Búsqueda semántica con modelo multilingüe e5 (vectores densos y fragmentación)

- Búsqueda híbrida con modelo de incrustación de texto Vertex AI

Puede encontrarlos en este repositorio de GitHub.

Veamos un ejemplo: crear incrustaciones con las API de IA de Vertex de Google Cloud en un catálogo de productos. Primero, necesitamos crear la plantilla de búsqueda en Elasticsearch como se muestra a continuación:

En este ejemplo, ejecutaremos la búsqueda KNN en dos campos dentro de una sola búsqueda: title_embedding – el campo vectorial que contiene el nombre del producto – y description_embedding – el que contiene la representación de su descripción.

Puede aprovechar la sintaxis excludes para evitar devolver campos innecesarios al LLM, lo que puede causar ruido en su procesamiento y afectar la calidad de la respuesta final. En nuestro ejemplo, excluimos los campos que contienen vectores y url de imágenes.

Los vectores se crean sobre la marcha en el momento de la consulta en la entrada enviada a través de un extremo de inferencia a la API de incrustaciones de Vertex AI, googlevertexai_embeddings_004, definida anteriormente de la siguiente manera:

Puedes encontrar información adicional sobre cómo usar la API de inferencia de Elastic aquí.

Ahora estamos listos para probar nuestra búsqueda con plantillas:

Los campos params reemplazarán las variables que establezcamos en los scripts de plantilla entre corchetes dobles. Actualmente, las API de Vertex AI LLM y Grounded Generation pueden enviar a Elastic las siguientes variables de entrada:

- "query" - la consulta del usuario que se va a buscar

- "index_name" - el nombre del índice donde buscar

- "num_hits": cuántos documentos queremos recuperar en la salida final

Aquí hay un ejemplo de salida:

La consulta anterior es precisamente lo que Vertex AI de Google Cloud ejecutará en Elasticsearch en segundo plano cuando se refiera a la plantilla de búsqueda creada anteriormente. Los modelos de Gemini usarán los documentos de salida para fundamentar su respuesta: cuando pregunte "¿Qué necesito para parchear mi panel de yeso?" en lugar de recibir una sugerencia genérica, ¡el agente de chat le proporcionará productos específicos!

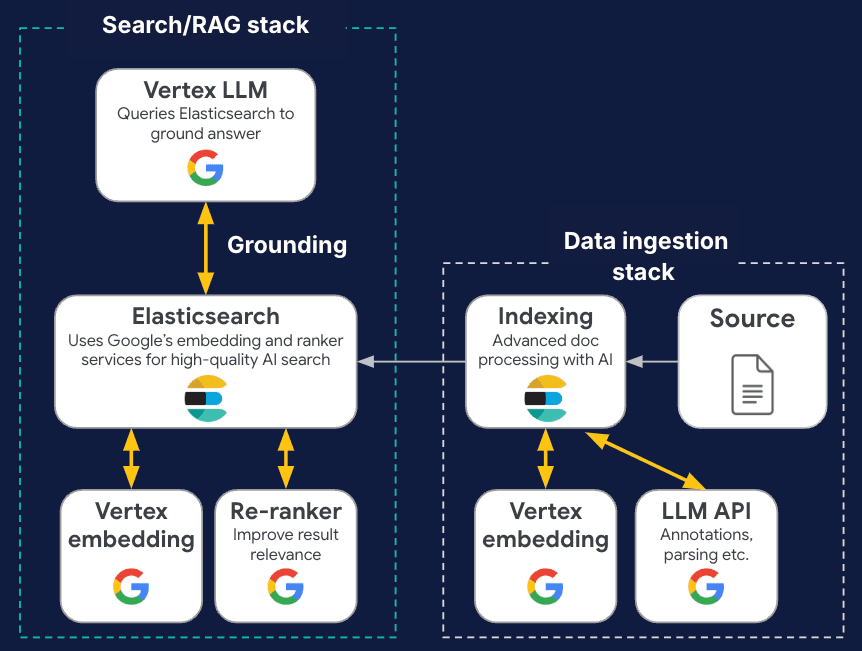

Viaje de GenAI de extremo a extremo con Elastic y Google Cloud

Elastic se asocia con Google Cloud para crear experiencias y soluciones GenAI integrales y listas para la producción. Como acabamos de ver, Elastic es el primer ISV que se integra directamente en la interfaz de usuario y el SDK para la plataforma Vertex AI, lo que permite que los modelos de Gemini sean precisos y fundamentados con indicaciones y agentes que emplean nuestras funciones de búsqueda vectorial. Además, Elastic se integra con Vertex AI y los modelos de inserción, reclasificación y finalización de Google AI Studiopara crear y clasificar vectores sin salir del panorama de Google Cloud, lo que garantiza los principios de IA responsable . Al admitir enfoques multimodales, facilitamos conjuntamente las aplicaciones en diversos formatos de datos.

Puedes ajustar, probar y exportar tu código de búsqueda de GenAI a través de nuestro Playground.

Pero no se trata solo de crear aplicaciones de búsqueda: Elastic aprovecha los modelos de Gemini para potenciar las operaciones de TI, como en las funciones Elastic AI Assistants, Attack Discovery y Automatic Import, lo que reduce la fatiga diaria de los analistas de seguridad y los SRE en tareas de bajo valor y les permite concentrar en mejorar su negocio. Elastic también permite un monitoreo integral del uso de Vertex AI, el seguimiento de métricas y logs, como tiempos de respuesta, tokens y recursos, para garantizar un rendimiento óptimo. Juntos, gestionamos todo el ciclo de vida de GenAI, desde la ingesta de datos y la generación de incrustaciones hasta la conexión a tierra con búsqueda híbrida, al tiempo que garantizamos una estable observabilidad y seguridad de las herramientas de GenAI con acciones impulsadas por LLM.

¡Explora más y pruébalo!

¿Estás interesado en probar esto? ¡La función está actualmente disponible con disponibilidad general en tus proyectos de Google Cloud!

Si aún no lo hiciste, una de las formas más fáciles de comenzar a usar Elastic Search AI Platform y explorar nuestras capacidades es con tu prueba gratis de Elastic Cloud o suscribiéndote a través de Google Cloud Marketplace.

El lanzamiento y el momento de cualquier característica o funcionalidad descrita en esta publicación quedan a discreción exclusiva de Elastic. Es posible que cualquier característica o funcionalidad que no esté disponible actualmente no se entregue a tiempo o no se entregue en absoluto. Elastic, Elasticsearch y las marcas asociadas son marcas comerciales, logotipos o marcas comerciales registradas de Elasticsearch N.V. en los Estados Unidos y otros países. Todos los demás nombres de empresas y productos son marcas comerciales, logotipos o marcas comerciales registradas de sus respectivos propietarios.

Preguntas frecuentes

¿Qué es la plataforma Vertex AI de Google Cloud?

Vertex AI es la plataforma unificada de Google Cloud para todo el ciclo de vida de la inteligencia artificial. Está diseñado para tender puentes entre la "investigación" y la "producción" reuniendo las mejores herramientas de aprendizaje automático (ML) y IA generativa de Google.

¿Cuáles son los beneficios de usar Elasticsearch en la plataforma Vertex AI de Google Cloud?

Los principales beneficios de usar Elasticsearch en la plataforma Vertex AI de Google son que solo se necesitan unos pocos pasos sencillos para configurar los extremos de Elastic con los parámetros deseados, como el índice a buscar o el número de documentos a recuperar.

¿Qué recursos tiene Elasticsearch para facilitar la configuración de consultas para modelos Gemini?

Elasticsearch tiene plantillas de búsqueda personalizables que pueden usar para crear consultas dinámicas y reutilizables.