Introducción

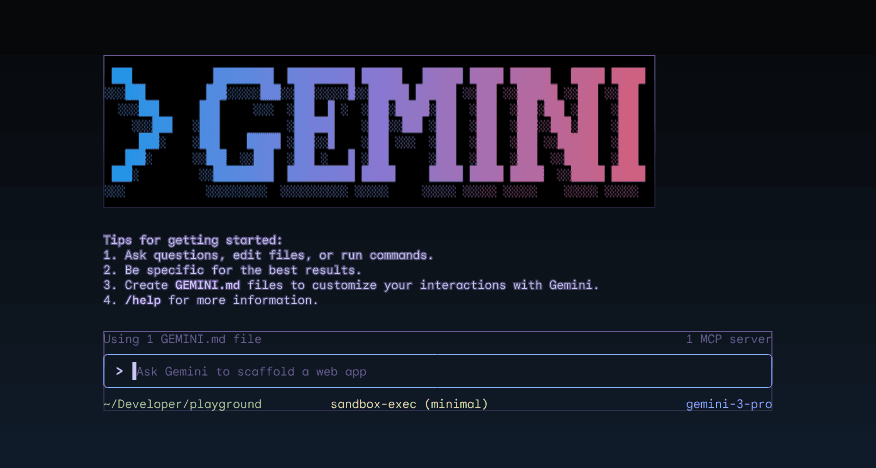

Este artículo te mostrará cómo construir un agente de IA para RRHH usando GPT-OSS y Elastic Agent Builder. El agente puede responder a tus preguntas sin enviar datos a OpenAI, Anthropic ni ningún servicio externo.

Usaremos LM Studio para servir GPT-OSS localmente y lo conectaremos a Elastic Agent Builder.

Al final de este artículo, tendrás un agente de IA personalizado que podrá responder preguntas en lenguaje natural sobre los datos de tus empleados manteniendo el control total sobre tu información y modelo.

Prerrequisitos

Para este artículo, necesitas:

- Elastic Cloud alojaba la versión 9.2, despliegue serverless o local

- Máquina con 32GB de RAM recomendada (mínimo 16GB para GPT-OSS 20B)

- LM Studio instalado

- Escritorio Docker Instalado

¿Por qué usar GPT-OSS?

Con un LLM local tienes el control para desplegarlo en tu propia infraestructura y ajustarlo para adaptarlo a tus propias necesidades. Todo esto manteniendo el control sobre los datos que compartes con el modelo y, por supuesto, no tienes que pagar una tasa de licencia a un proveedor externo.

OpenAI lanzó GPT-OSS el 5 de agosto de 2025, como parte de su compromiso con el ecosistema del modelo abierto.

El modelo de parámetros 20B ofrece:

- Capacidades de uso de herramientas

- Inferencia eficiente

- Compatible con SDK OpenAI

- Compatible con flujos de trabajo agentes

Comparación de referencias:

Fuente de referencia.

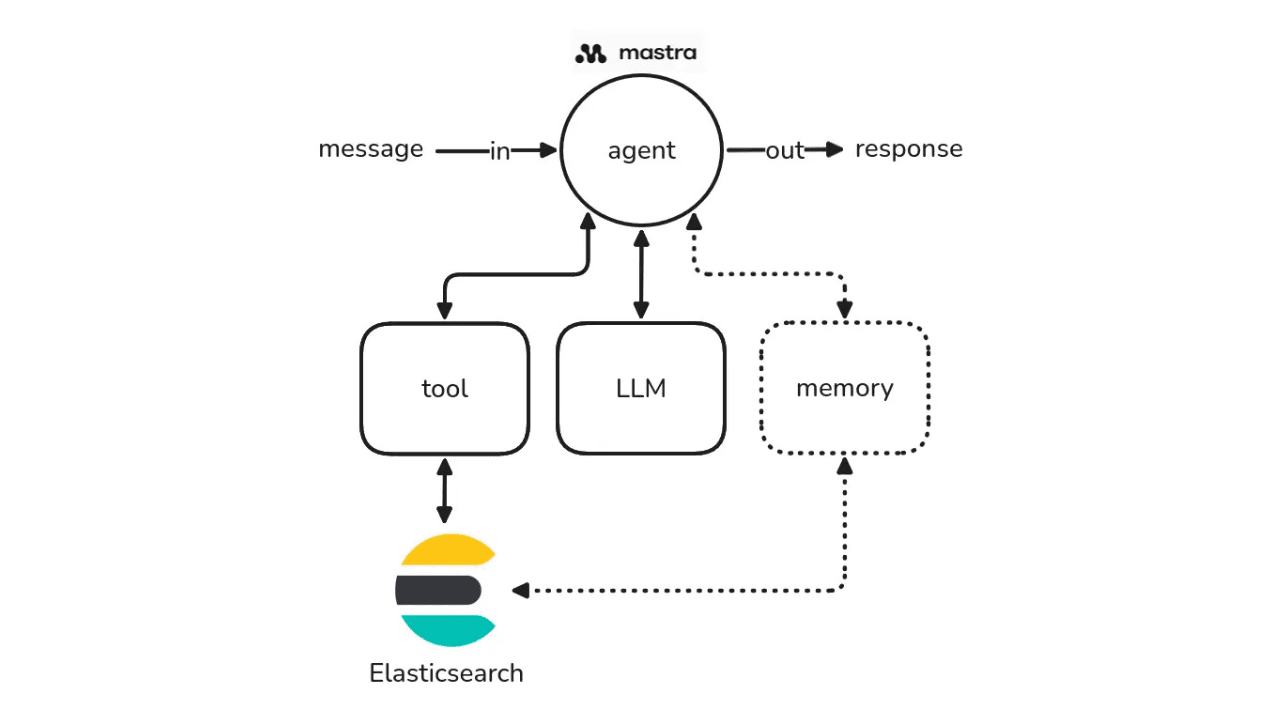

Arquitectura de soluciones

La arquitectura funciona completamente en tu máquina local. Elastic (que funciona en Docker) se comunica directamente con tu LLM local a través de LM Studio, y Elastic Agent Builder emplea esta conexión para crear agentes de IA personalizados que pueden consultar los datos de tus empleados.

Para más detalles, consulte esta documentación.

Construir un agente de IA para RRHH: Pasos

Dividiremos la implementación en 5 pasos:

- Configurar LM Studio con un modelo local

- Despliega Elastic Local con Docker

- Crea el conector OpenAI en Elastic

- Sube los datos de los empleados a Elasticsearch

- Construye y prueba tu agente de IA

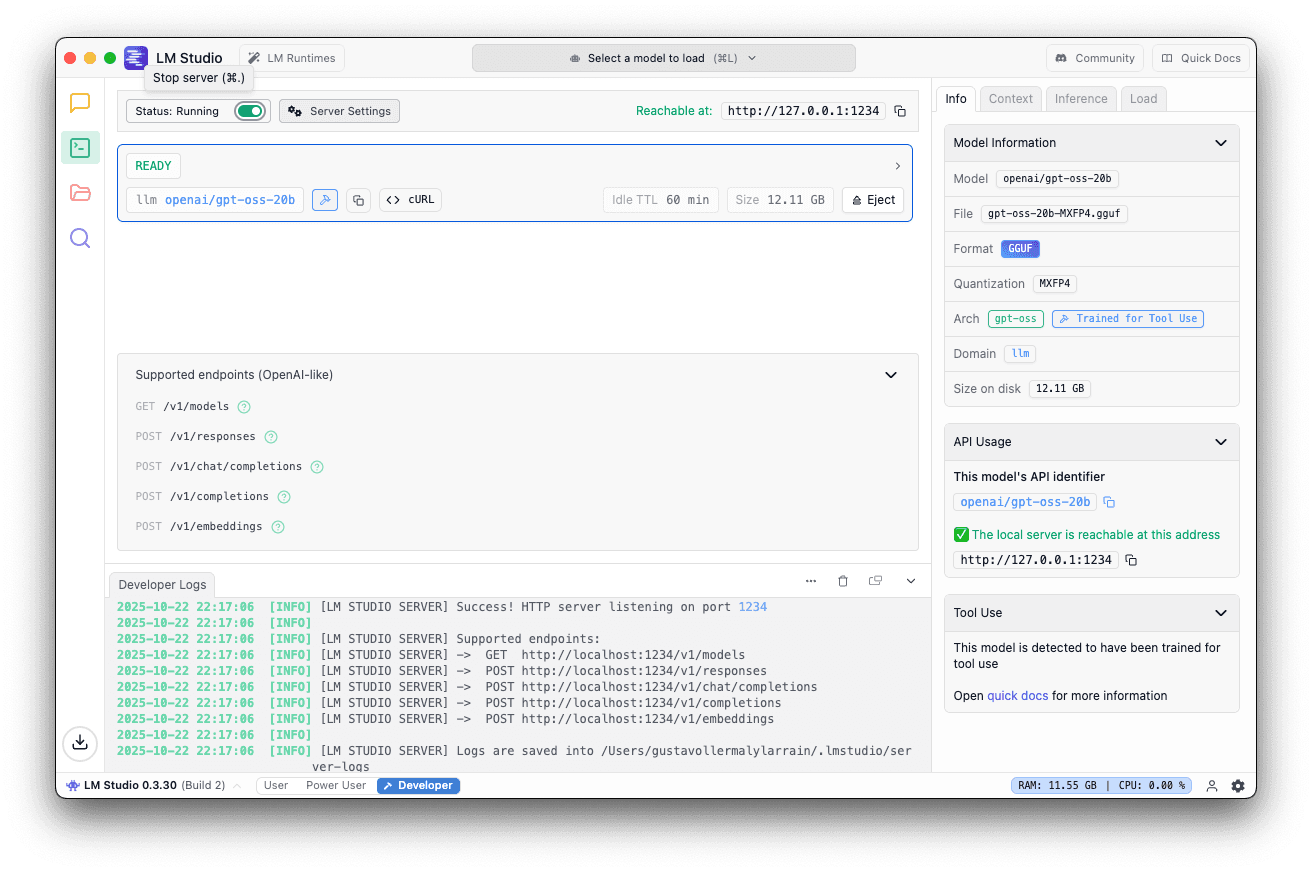

Paso 1: Configurar LM Studio con GPT-OSS 20B

LM Studio es una aplicación fácil de usar que te permite ejecutar grandes modelos de lenguaje localmente en tu computadora. Proporciona un servidor API compatible con OpenAI, lo que facilita su integración con herramientas como Elastic sin un proceso de configuración complejo. Para más detalles, consulta la documentación de LM Studio.

Primero, descarga e instala LM Studio desde el sitio web oficial. Una vez instalado, abre la aplicación.

En la interfaz de LM Studio:

- Ve a la pestaña de búsqueda y busca "GPT-OSS"

- Selecciona el

openai/gpt-oss-20bde OpenAI - Haz clic en descargar

El tamaño de este modelo debería ser aproximadamente 12,10GB. La descarga puede tardar unos minutos, dependiendo de tu conexión a Internet.

Una vez descargado el modelo:

- Ve a la pestaña del servidor local

- Selecciona el openai/gpt-oss-20b

- Usa el puerto predeterminado 1234

- En el panel derecho, ve a Cargar y establece la longitud de contexto en 40K o más

5. Haz clic en iniciar servidor

Deberías ver esto si el servidor está funcionando.

Paso 2: Desplegar Elastic Local con Docker

Ahora configuraremos Elasticsearch y Kibana localmente usando Docker. Elastic proporciona un script conveniente que gestiona todo el proceso de configuración. Para más detalles, consulte la documentación oficial.

Ejecuta el script de inicio local

Ejecuta el siguiente comando en tu terminal:

Este guion será:

- Descargar y configurar Elasticsearch y Kibana

- Inicia ambos servicios usando Docker Compose

- Activa automáticamente una licencia de prueba Platinum de 30 días

Producción esperada

Solo espera el siguiente mensaje y almacena la contraseña y la clave API que se muestra; los necesitarás para acceder a Kibana:

Acceso a Kibana

Abre tu navegador y navega a:

Inicia sesión usando las credenciales obtenidas en la salida del terminal.

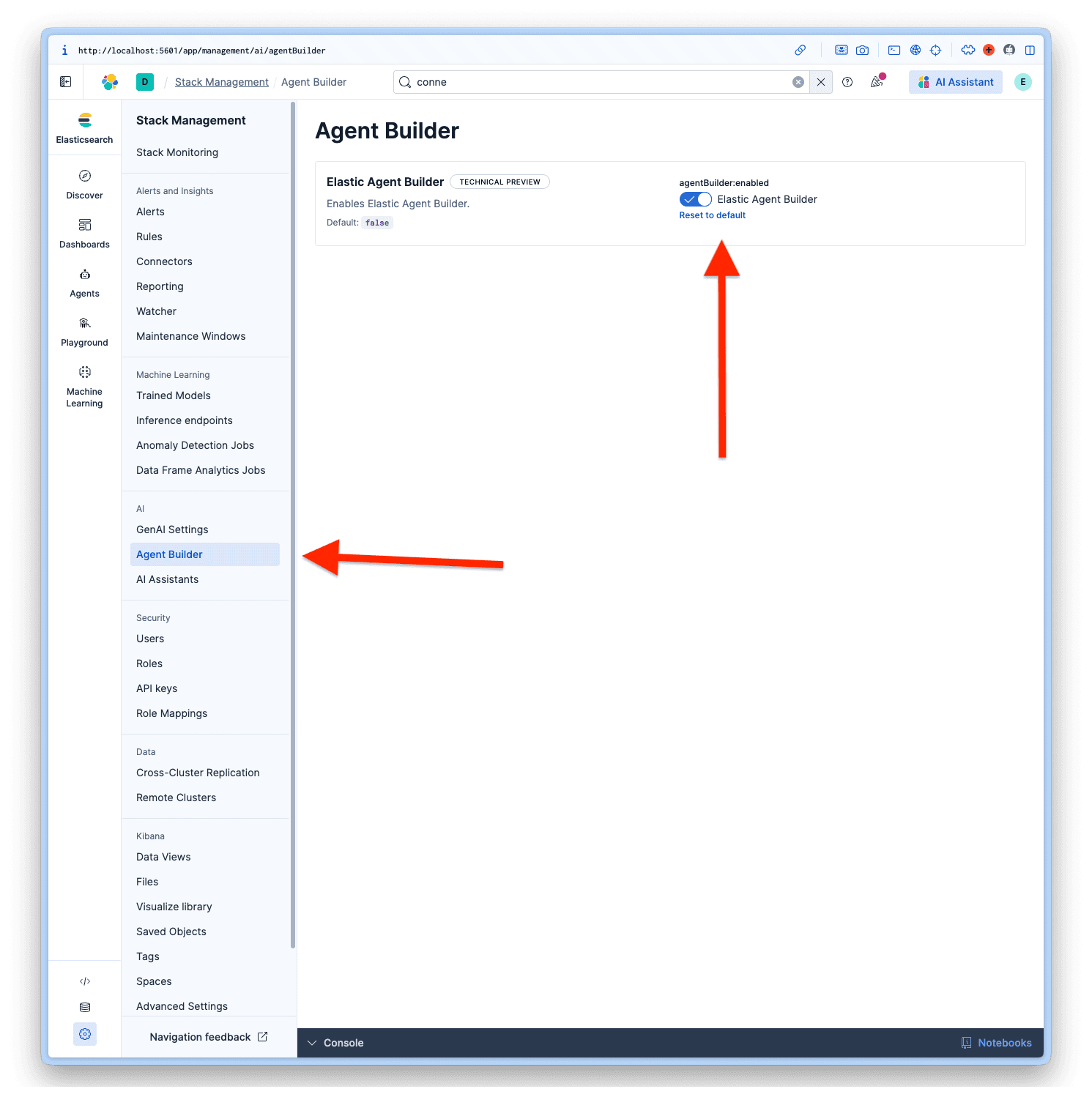

Habilitar Agent Builder

Una vez iniciado sesión en Kibana, navega a Management > AI > Agent Builder y activa el Agent Builder.

Paso 3: Crea el conector OpenAI en Elastic

Ahora configuraremos Elastic para que use tu LLM local.

Conectores de acceso

- En Kibana

- Ve a Configuración > Gestión del Proyecto

- En Alertas e Información, selecciona Conectores

- Haz clic en Crear conector

Configurar el conector

Selecciona OpenAI de la lista de conectores. LM Studio emplea el SDK OpenAI, lo que lo hace compatible.

Diligencia el espacio con estos valores:

- Nombre del conector: LM Studio - GPT-OSS 20B

- Selecciona un proveedor de OpenAI: Otros (Servicio compatible con OpenAI)

- URL:

http://host.docker.internal:1234/v1/chat/completions - Modelo por defecto: openai/gpt-oss-20b

- API Key: testkey-123 (cualquier texto funciona, porque LM Studio Server no requiere autenticación.)

Para terminar la configuración, haz clic en Almacenar y probar.

Importante: Activa la opción "Habilitar la llamada a funciones nativas"; esto es necesario para que el Constructor de Agentes funcione correctamente. Si no activas esto, te aparecerá un error de No tool calls found in the response .

Prueba la conexión

El elástico debería probar automáticamente la conexión. Si todo está configurado correctamente, verás un mensaje de éxito como este:

Respuesta:

Paso 4: Subir los datos de los empleados a Elasticsearch

Ahora subiremos el conjunto de datos de empleados de RRHH para demostrar cómo el agente trabaja con datos sensibles. Generé un conjunto de datos ficticio con esta estructura.

Estructura del conjunto de datos

Crea el índice con mapeos

Primero, crea el índice con mapeos adecuados. Ten en cuenta que estamos usando semantic_text campos para algunos campos clave; Esto permite capacidades de búsqueda semántica para nuestro índice.

Índice con API Bulk

Copia y pega el conjunto de datos en tus Dev Tools en Kibana y ejecutalo:

Verifica los datos

Realiza una consulta para verificar:

Paso 5: Construye y prueba tu agente de IA

Con todo configurado, es hora de crear un agente de IA personalizado usando Elastic Agent Builder. Para más detalles, consulte la documentación de Elastic.

Agregar el conector

Antes de poder crear nuestro nuevo agente, tenemos que configurar nuestro constructor de agentes para usar nuestro conector personalizado llamado LM Studio - GPT-OSS 20B porque el predeterminado es el Elastic Managed LLM. Para eso, necesitamos ir a Configuración > Gestión de Proyectos > Configuración de GenAI; ahora seleccionamos la que creamos y hacemos clic en Almacenar.

Constructor de Agentes de Acceso

- Ir a Agentes

- Haz clic en Crear un nuevo agente

Configurar el agente

Para crear un nuevo agente, los campos requeridos son el ID del agente, el nombre de visualización y las instrucciones de visualización.

Pero hay más opciones de personalización, como las Instrucciones Personalizadas que guían cómo se comportará tu agente e interactuará con tus herramientas, similar a una indicación del sistema, pero para nuestro agente personalizado. Las etiquetas ayudan a organizar tus agentes, el color del avatar y el símbolo del avatar.

Los que elegí para nuestro agente basándome en el conjunto de datos son:

ID del agente: hr_assistant

Instrucciones personalizadas:

Etiquetas: Human Resources y GPT-OSS

Nombre de visualización: HR Analytics Assistant

Descripción de la exposición:

Con todos los datos ahí, podemos hacer clic en Almacenar a nuestro nuevo agente.

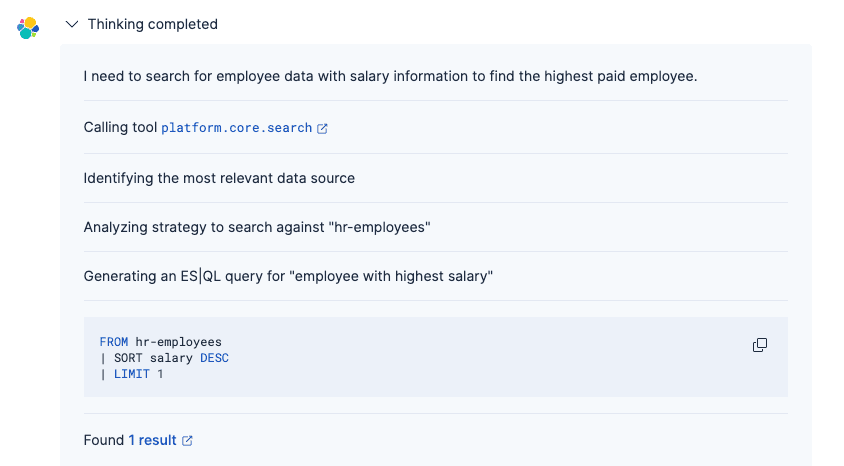

Prueba al agente

Ahora puedes hacer preguntas en lenguaje natural sobre los datos de tus empleados, y GPT-OSS 20B entenderá la intención y generará una respuesta adecuada.

Pronto:

Respuesta:

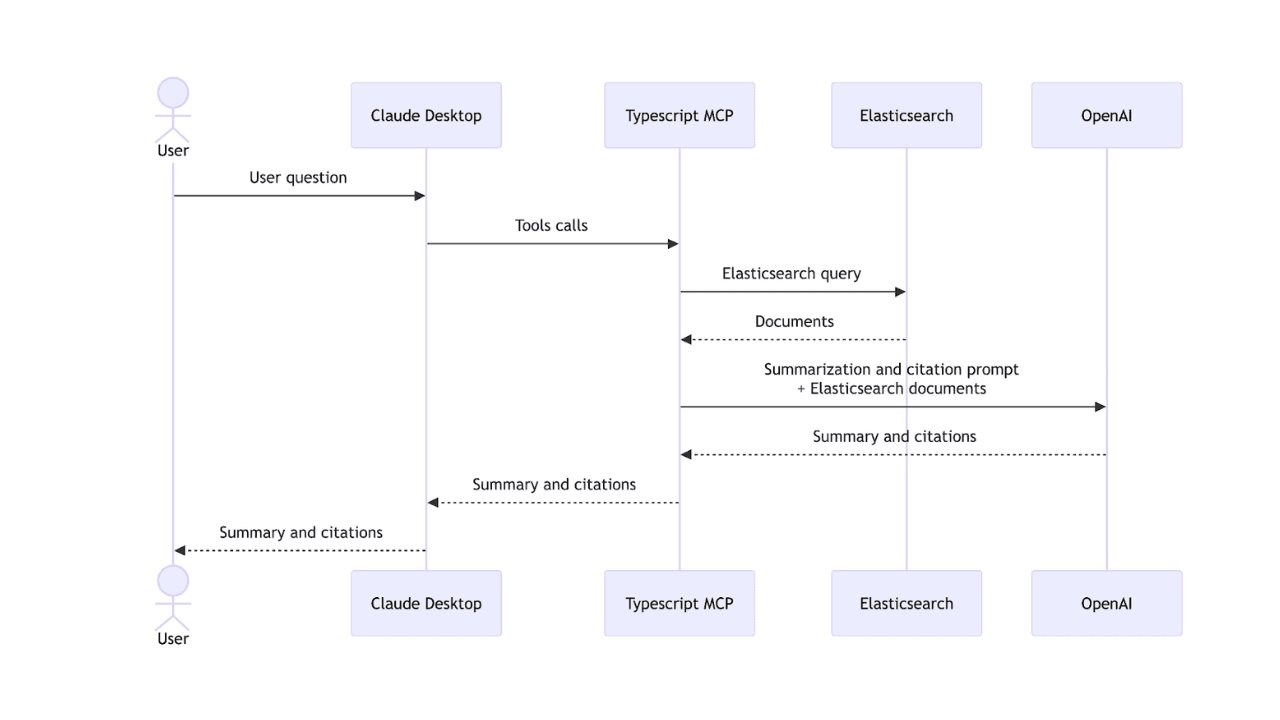

El proceso de Agente fue:

1. Entiende tu pregunta usando el conector GPT-OSS

2. Generar la consulta Elasticsearch adecuada (usando las herramientas integradas o ES| personalizadoQL)

3. Recuperar los registros de empleados coincidentes

4. Presentar resultados en lenguaje natural con un formato adecuado

A diferencia de la búsqueda léxica tradicional, el agente impulsado por GPT-OSS entiende la intención y el contexto, facilitando encontrar información sin conocer los nombres exactos de los campos o la sintaxis de la consulta. Para más detalles sobre el proceso de pensamiento del agente, consulta este artículo.

Conclusión

En este artículo, creamos un agente de IA personalizado usando el Agent Builder de Elastic para conectarse al modelo OpenAI GPT-OSS que se ejecuta localmente. Al desplegar tanto Elastic como el LLM en tu máquina local, esta arquitectura te permite aprovechar las capacidades de IA generativa manteniendo el control total sobre tus datos, todo ello sin enviar información a servicios externos.

Usamos GPT-OSS 20B como experimento, pero aquí se hacen referencia a los modelos oficialmente recomendados para Elastic Agent Builder. Si necesitas capacidades de razonamiento más avanzadas, también está la variante de parámetros 120B que rinde mejor para escenarios complejos, aunque requiere una máquina de especificaciones más altas para ejecutar localmente. Para más detalles, consulte la documentación oficial de OpenAI.