A2A und MCP: Der Code in Aktion

Dies ist der Begleitartikel zum Artikel „Erstellung eines LLM-Agent-Newsrooms mit A2A-Protokoll und MCP in Elasticsearch!“, in dem die Vorteile der Implementierung von A2A- und MCP-Architekturen innerhalb desselben Agenten erläutert wurden, um die einzigartigen Vorteile beider Frameworks voll auszuschöpfen. Ein Repository steht zur Verfügung, falls Sie die Demo selbst ausführen möchten.

Lassen Sie uns gemeinsam durchgehen, wie unsere Redakteure mithilfe von A2A und MCP zusammenarbeiten, um einen Nachrichtenartikel zu erstellen. Das zugehörige Repository, um die Agenten in Aktion zu sehen, finden Sie hier.

Schritt 1: Aufgabenstellung für die Geschichte

Der Nachrichtenchef (in der Rolle des Auftraggebers) vergibt eine Story:

Schritt 2: Der Reporter bittet um Recherche

Der Reporteragent erkennt, dass er Hintergrundinformationen benötigt und delegiert diese über A2A an den Rechercheagenten :

Schritt 3: Der Reporter bittet den Archivar um historischen Kontext.

Der Reporteragent erkennt, dass ein historischer Kontext die Geschichte stärken würde. Es delegiert über A2A an den Archivagenten (basierend auf dem A2A-Agenten von Elastic), um das Elasticsearch-basierte Artikelarchiv des Newsrooms zu durchsuchen:

Schritt 4: Der Archivierungsagent verwendet den Elastic A2A-Agenten mit MCP.

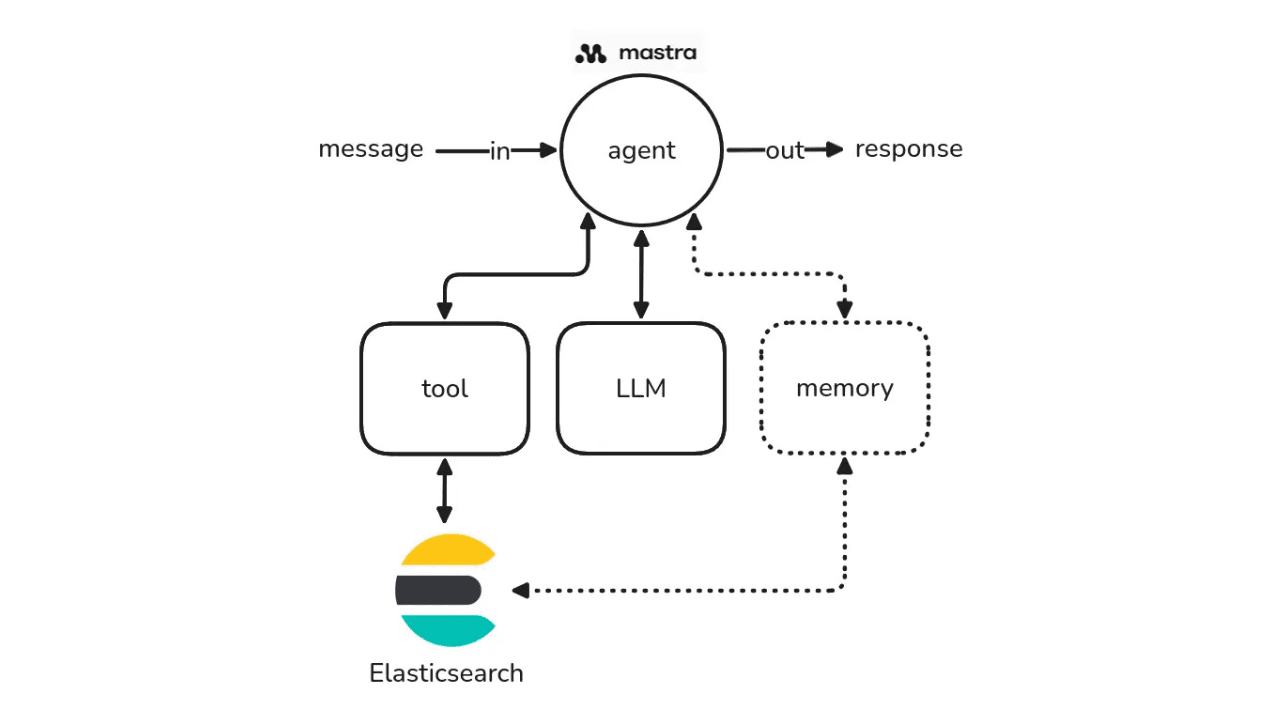

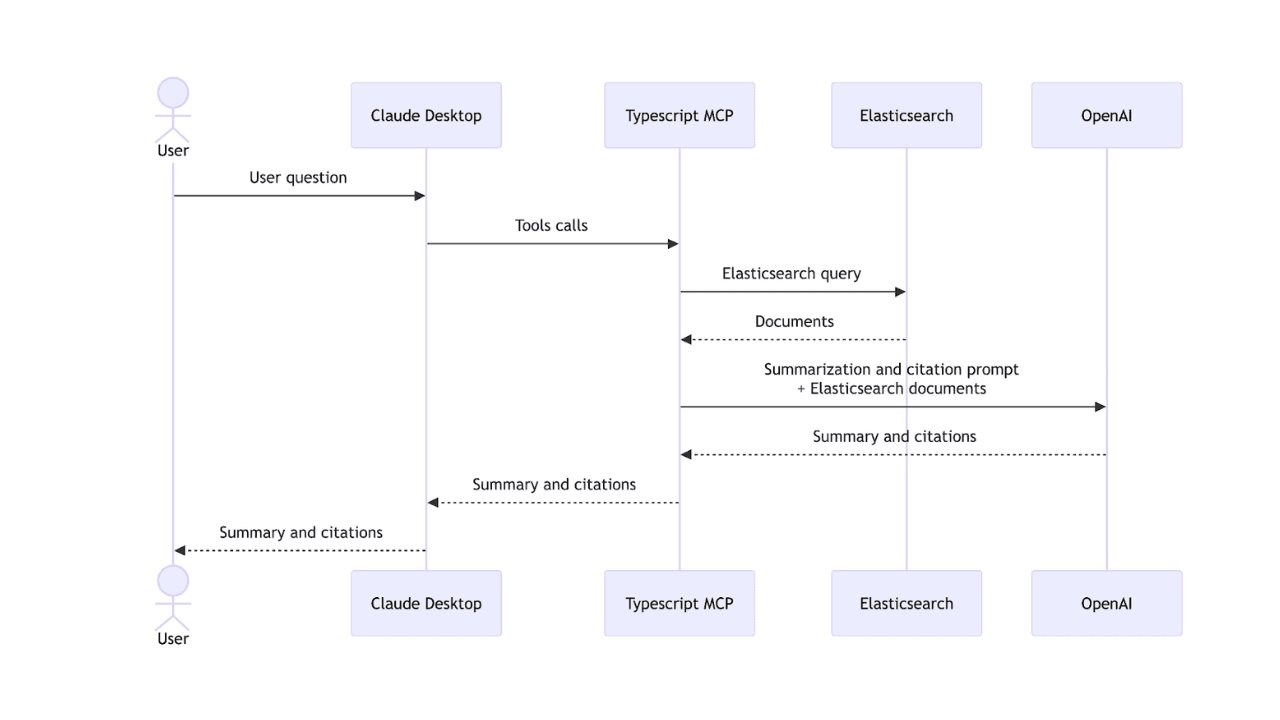

Der Archive Agent verwendet den A2A Agent von Elastic, der wiederum MCP nutzt, um auf die Elasticsearch-Tools zuzugreifen. Dies veranschaulicht die Hybridarchitektur, bei der A2A die Zusammenarbeit von Agenten ermöglicht, während MCP den Zugriff auf Werkzeuge bereitstellt:

Der Archivagent empfängt umfassende historische Daten vom A2A-Agenten von Elastic und sendet sie an den Reporter zurück:

Dieser Schritt demonstriert, wie sich der A2A-Agent von Elastic in den Workflow der Nachrichtenredaktion integriert. Der Archive Agent (ein speziell für Redaktionen entwickelter Agent) koordiniert sich mit dem A2A Agent von Elastic (einem Drittanbieter-Spezialisten), um die leistungsstarken Such- und Analysefunktionen von Elasticsearch optimal zu nutzen. Der Elastic-Agent nutzt intern MCP für den Zugriff auf Elasticsearch-Tools, was die klare Trennung zwischen Agentenkoordination (A2A) und Toolzugriff (MCP) verdeutlicht.

Schritt 5: Der Forscher nutzt MCP-Server

Der Forschungsagent greift auf mehrere MCP-Server zu, um Informationen zu sammeln:

Schritt 6: Der Forscher übermittelt die Daten an den Reporter.

Der Rechercheagent sendet die umfassenden Rechercheergebnisse über A2A zurück:

Schritt 7: Der Reporter schreibt einen Artikel

Der Reporteragent nutzt die Forschungsdaten und seine eigenen LLM-Fähigkeiten, um den Artikel zu schreiben. Beim Schreiben nutzt der Reporter die MCP-Server für Stil und Vorlagen:

Schritt 8: Geringes Vertrauen löst erneute Recherche aus

Der Reporteragent prüft den Entwurf und stellt fest, dass eine Behauptung nur geringes Vertrauen genießt. Es sendet eine weitere Anfrage an den Forschungsagenten:

Der Forscher überprüft die Behauptung mithilfe von Faktencheck-Servern von MCP und liefert aktualisierte Informationen zurück:

Schritt 9: Der Reporter überarbeitet den Text und reicht ihn beim Redakteur ein.

Der Reporter integriert die verifizierten Fakten und sendet den fertigen Entwurf per A2A an den Redaktionsagenten :

Schritt 10: Redaktionelle Überprüfungen mithilfe von MCP-Tools

Der Redaktionsagent nutzt mehrere MCP-Server zur Überprüfung des Artikels:

Der Redakteur genehmigt den Artikel und leitet ihn weiter:

Schritt 11: Der Herausgeber veröffentlicht über CI/CD

Schließlich veröffentlicht der Druckeragent den genehmigten Artikel mithilfe der MCP-Server für die CMS- und CI/CD-Pipeline:

Der Verlag bestätigt die Veröffentlichung via A2A:

Hier ist die vollständige Abfolge des A2A-Workflows im zugehörigen Repository unter Verwendung der oben beschriebenen Agenten.

| # | Aus | Zu | Aktion | Protokoll | Beschreibung |

|---|---|---|---|---|---|

| 1 | Benutzer | Nachrichtenchef | Geschichte zuweisen | HTTP POST | Der Nutzer gibt Thema und Blickwinkel der Geschichte vor. |

| 2 | Nachrichtenchef | Intern | Geschichte erstellen | - | Erstellt einen Story-Datensatz mit eindeutiger ID |

| 3 | Nachrichtenchef | Reporter | Delegiertenzuweisung | A2A | Sendet die Story-Aufgabe über das A2A-Protokoll. |

| 4 | Reporter | Intern | Auftrag annehmen | - | Interne Zuordnung der Lagerbestände |

| 5 | Reporter | MCP-Server | Gliederung erstellen | MCP/HTTP | Erstellt Gliederungen für Artikel und Forschungsfragen |

| 6a | Reporter | Forscher | Forschungsanfrage | A2A | Sendet Fragen (parallel zu 6b) |

| 6b | Reporter | Archivar | Archiv durchsuchen | A2A JSONRPC | Durchsucht historische Artikel (parallel zu 6a) |

| 7 | Forscher | MCP-Server | Forschungsfragen | MCP/HTTP | Nutzt Anthropic über MCP, um Fragen zu beantworten |

| 8 | Forscher | Reporter | Forschung zurückgeben | A2A | Antworten zur Renditeforschung |

| 9 | Archivar | Elasticsearch | Suchindex | ES REST-API | Abfragen zum Nachrichtenarchivindex |

| 10 | Archivar | Reporter | Zurück zum Archiv | A2A JSONRPC | Gibt historische Suchergebnisse zurück |

| 11 | Reporter | MCP-Server | Artikel generieren | MCP/HTTP | Erstellt einen Artikel mit Recherche-/Archivkontext |

| 12 | Reporter | Intern | Entwurf speichern | - | Speichert den Entwurf intern. |

| 13 | Reporter | Nachrichtenchef | Entwurf einreichen | A2A | Reicht den fertigen Entwurf ein |

| 14 | Nachrichtenchef | Intern | Update zur Geschichte | - | Speichert den Entwurf, aktualisiert den Status auf "draft_submitted" |

| 15 | Nachrichtenchef | Editor | Entwurf prüfen | A2A | Automatische Weiterleitung an den Redakteur zur Überprüfung |

| 16 | Editor | MCP-Server | Rezensionsartikel | MCP/HTTP | Analysiert Inhalte mithilfe von Anthropic über MCP |

| 17 | Editor | Nachrichtenchef | Rückgabeprüfung | A2A | Sendet redaktionelles Feedback und Vorschläge |

| 18 | Nachrichtenchef | Intern | Ladenbewertung | - | Feedback der Ladenredaktion |

| 19 | Nachrichtenchef | Reporter | Änderungen anwenden | A2A | Feedback zur Routenbewertung an den Reporter |

| 20 | Reporter | MCP-Server | Änderungen anwenden | MCP/HTTP | Überarbeitet den Artikel basierend auf dem Feedback |

| 21 | Reporter | Intern | Entwurf aktualisieren | - | Aktualisiert den Entwurf mit den Überarbeitungen |

| 22 | Reporter | Nachrichtenchef | Rückgabe überarbeitet | A2A | Artikel über die Rückgabe überarbeitet |

| 23 | Nachrichtenchef | Intern | Update zur Geschichte | - | Die Geschäfte haben den Entwurf überarbeitet, der Status lautet nun „überarbeitet“. |

| 24 | Nachrichtenchef | Herausgeber | Artikel veröffentlichen | A2A | Automatische Weiterleitung zum Herausgeber |

| 25 | Herausgeber | MCP-Server | Tags generieren | MCP/HTTP | Erstellt Tags und Kategorien |

| 26 | Herausgeber | Elasticsearch | Indexartikel | ES REST-API | Indexiert Artikel im Nachrichtenarchivindex |

| 27 | Herausgeber | Dateisystem | Markdown speichern | Datei-E/A | Speichert den Artikel als .md-Datei Datei in /articles |

| 28 | Herausgeber | Nachrichtenchef | Veröffentlichung bestätigen | A2A | Rückgabestatus: Erfolgreich |

| 29 | Nachrichtenchef | Intern | Update zur Geschichte | - | Aktualisiert den Status der Story auf „veröffentlicht“. |

Fazit

Sowohl A2A als auch MCP spielen eine wichtige Rolle im modernen erweiterten LLM-Infrastrukturparadigma. A2A bietet Flexibilität für komplexe Multiagentensysteme, jedoch potenziell geringere Portabilität und höhere operative Komplexität. MCP bietet einen standardisierten Ansatz für die Tool-Integration, der einfacher zu implementieren und zu warten ist, ist jedoch nicht für die Orchestrierung mehrerer Agenten ausgelegt.

Die Wahl ist nicht binär. Wie unser Beispiel aus der Redaktion zeigt, kombinieren die anspruchsvollsten und effektivsten LLM-gestützten Systeme oft beide Ansätze: Agenten koordinieren und spezialisieren sich über A2A-Protokolle, während sie über MCP-Server auf ihre Tools und Ressourcen zugreifen. Diese Hybridarchitektur bietet die organisatorischen Vorteile von Multiagentensystemen sowie die Standardisierungs- und Ökosystemvorteile von MCP. Dies deutet darauf hin, dass möglicherweise gar keine Wahlmöglichkeit besteht: Man könnte einfach beide als Standardansatz verwenden.

Es liegt an Ihnen als Entwickler oder Architekt, die beste Mischung beider Lösungen zu testen und zu ermitteln, um das richtige Ergebnis für Ihren spezifischen Anwendungsfall zu erzielen. Das Verständnis der Stärken, Grenzen und geeigneten Anwendungsbereiche der einzelnen Ansätze ermöglicht es Ihnen, effektivere, wartungsfreundlichere und skalierbare KI-Systeme zu entwickeln.

Egal, ob Sie eine digitale Nachrichtenredaktion, eine Kundenserviceplattform, einen Forschungsassistenten oder eine andere LLM-gestützte Anwendung entwickeln – die sorgfältige Berücksichtigung Ihrer Koordinierungsbedürfnisse (A2A) und Ihrer Anforderungen an den Werkzeugzugriff (MCP) wird Sie auf den Weg zum Erfolg führen.

Weitere Ressourcen

- Elasticsearch Agent Builder: https://www.elastic.co/docs/solutions/search/elastic-agent-builder

- A2A-Spezifikation: https://a2a-protocol.org/latest/specification/

- A2A- und MCP-Integration: https://a2a-protocol.org/latest/topics/a2a-and-mcp/

- Model Context Protocol: https://modelcontextprotocol.io