Elastic präsentiert Elastic AI Assistant

Mit Elastic AI Assistant stellt Elastic® einen offenen, auf der Basis von generativer KI arbeitenden Assistenten, powered by ESRE, bereit, der zur Demokratisierung der Cybersicherheit beiträgt und sich an Nutzer:innen aller Qualifikationsstufen richtet.

Die kürzlich eingeführte Elasticsearch Relevance Engine™ (ESRE™) bietet neue Funktionen für die Erstellung hochrelevanter KI-Suchanwendungen. ESRE baut auf mehr als zwei Jahren fokussierter Forschung und Entwicklung im Bereich Machine Learning auf, die wiederum durch die führende Rolle von Elastic bei Anwendungsfällen für die Suche möglich gemacht wurde.

ESRE kombiniert die Stärken von KI mit der textbasierten Suche von Elastic und bietet Entwickler:innen eine vollständige Suite aus komplexen Abrufalgorithmen und Integrationsmöglichkeiten mit Large Language Models (LLMs). Der Zugriff auf die Lösung erfolgt über eine einfache Einheits-API, die die Elastic-Community bereits kennt, sodass Entwickler:innen in aller Welt sofort damit beginnen können, die Suchrelevanz zu verbessern.

Heute bauen wir mit unserer ersten domänenspezifischen Anwendung für Cybersicherheit auf diesen Innovationen auf. Dank der Wurzeln von Elastic in der Entwicklung offener Softwareprodukte und des hohen Innovationstempos des Unternehmens erhalten alle Nutzer:innen Zugang zu leistungsstarker Technologie, die ihnen hilft, ihre ganz speziellen geschäftlichen Herausforderungen zu lösen. Die rasanten Fortschritte der generativen KI haben es Elastic ermöglicht, den nächsten Schritt zu gehen und diese Funktionen allen Security-Analyst:innen zur Verfügung zu stellen.

Durch die einzigartige Art und Weise, wie Elastic AI Assistant an die Integration generativer KI herangeht, kommen die Nutzer:innen in den Genuss etlicher Vorteile, von denen im Folgenden nur einige aufgezählt werden:

Offen und transparent

Das offene Framework von Elastic AI Assistant versetzt Nutzer:innen in die Lage, sich problemlos an die sich schnell wandelnde LLM-Landschaft anzupassen und sich einfach und schnell mit neuen Modellen zu verbinden, um domänenspezifische Modelle für die unterschiedlichsten Anwendungen miteinander vergleichen und das jeweils passende Modell auswählen zu können. Beginnend mit Microsoft Azure OpenAI und OpenAI erhalten die Nutzer:innen freie Wahl, welche Prompts und Daten an welches Modell gesendet werden sollen. Das garantiert, dass jede Entscheidung von entsprechenden Maßnahmen hinsichtlich Sicherheit, Datenschutz und Effizienz flankiert wird.

Ein weiterer einzigartiger Vorteil für Elastic-Kunden besteht darin, dass sich bestehende LLMs durch die Fülle öffentlich verfügbarer Produktinformationen zu Elastic bestens mit Elastic Security auskennen, was die Genauigkeit der generierten Ergebnisse verbessert. Anbieter mit einem herkömmlichen geschlossenen Ansatz können diesen Grad an Effektivität mit diesen Modellen nicht erreichen, da bei solchen „Black Box“-Produkten vergleichsweise wenig öffentliche technische Informationen verfügbar sind.

Für alle Analyst:innen

Elastic-Nutzer:innen profitieren von einer zentralen Data-Analytics-Plattform, durch die sich die Kosten und die Komplexität der Erfassung, Speicherung und Analyse von Daten deutlich reduzieren. Mit Elastic AI Assistant vervielfacht sich dieser Vorteil. Der Assistent lässt sich für zahllose Security-Anwendungsfälle einsetzen und einfache integrierte Prompts unterstützen bei der anwendungsfallspezifischen Anwendung, während gleichzeitig die Möglichkeit der freien Formulierung die Flexibilität bietet, weit über das hinauszugehen, was die integrierten Funktionen bieten. Nutzer:innen können sogar eigene Prompts erstellen und diese an andere Teammitglieder weitergeben, sodass Elastic AI Assistant sich weiterentwickeln kann, um Ihrem Unternehmen bestmöglich zu dienen.

Secure by Design

Elastic zeigt alle Daten an, die an das LLM gesendet werden, und ermöglicht es den Nutzer:innen, die übermittelten Informationen unkenntlich zu machen, zu entfernen oder zu ändern. Wir arbeiten dabei mit Anbietern zusammen, für die die Sicherheit von Kundeninformationen oberste Priorität hat, und beginnen dabei mit Microsoft Azure OpenAI.

Relevant dank ESRE

Large Language Models (LLMs) sind beeindruckend und haben beinahe etwas Magisches an sich. Damit ein LLM eine Antwort geben kann, die für ein konkretes Unternehmen von Wert ist, benötigt es aber relevanten Kontext. Ohne diesen Kontext erhalten Nutzer:innen allgemeine Informationen, die auf öffentlich verfügbaren Daten basieren, mit denen dieses Modell trainiert wurde. ESRE hilft Kunden, diese Herausforderungen zu bewältigen, indem die Engine den organisationsspezifischen Kontext bereitstellt, sodass für jede Antwort Daten herangezogen werden, die für die jeweilige Organisation relevant sind.

Unzählige Anwendungsfälle

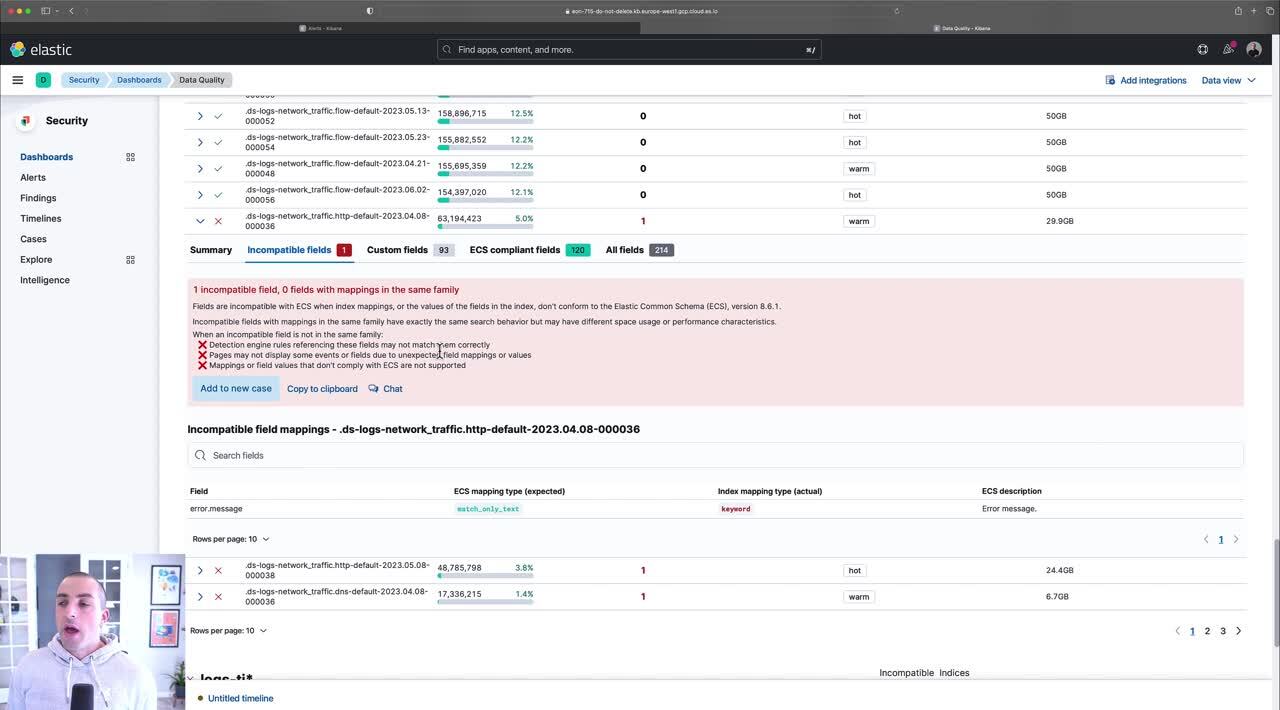

Elastic AI Assistant unterstützt Ihr Cybersicherheitsteam mit generativer KI. So können Nutzer:innen bei einer Vielzahl von Aufgaben mit Elastic Security interagieren – von der Untersuchung von Alerts über das Reagieren auf Sicherheitsvorfälle bis hin zum Generieren und Konvertieren von Suchanfragen mithilfe natürlicher Sprache. Gegenwärtig wird dies über einen Connector für OpenAI und Azure OpenAI Service realisiert.

Elastic AI Assistant kann mit einer einfachen Tastaturkombination oder über kontextbezogene Links in Elastic Security aufgerufen werden. Das Tool bietet sowohl vorkonfigurierte Prompt-Empfehlungen als auch spezifischen Kontext für das LLM. Prompts und Kontext sind entscheidende Faktoren für die Relevanz generativer KI für Ihr Team. Der Prompt gewährleistet, dass die Antwort des LLM für die richtige Nutzerin bzw. den richtigen Nutzer geschrieben ist (z. B. eine:n Tier‑1- oder Tier‑2-Security-Analyst:in), und der Kontext sind die organisationsspezifischen Informationen, anhand derer die Antwort auf konkrete Probleme zugeschnitten wird. Elastic AI Assistant bietet integrierte Prompts, die diesen Prozess vereinfachen – ein Klick genügt!

Hier ein paar Beispiele für integrierte Prompts, die gegenwärtig verfügbar sind:

- Alert-Zusammenfassung: Dieser Prompt stellt ein Alert-Dokument als Kontext bereit und gibt eine detaillierte Beschreibung der Gründe für die Alert-Auslösung und der empfohlenen Schritte zur Untersuchung und Bekämpfung des Angriffs zurück. Dieser Prompt-Typ kann ein dynamisches Runbook für die Organisation generieren.

- Workflow-Vorschläge: Dieser Prompt-Typ kann eine Schrittanleitung für die Ausführung einer Aufgabe in Elastic, z. B. für das Hinzufügen einer Alarmausnahme oder das Erstellen eines individuellen Dashboards, zum Ergebnis haben.

- Suchanfragenkonvertierung: Mit dieser Art von Prompt, die bei der Migration von Legacy-SIEMs helfen kann, können Nutzer:innen eine Suchanfrage aus einem anderen Produkt einfügen, woraufhin Elastic AI Assistant diese Suchanfrage in eine Elastic-Suchanfrage konvertiert. Dieser Prozess kann nachweislich die Zeit und die Kosten für die SIEM-Migration reduzieren.

- Ratschläge für die Agent-Integration: Wenn Sie Informationen erfassen möchten, aber nicht wissen, wie Sie dazu am besten in Elastic vorgehen, bitten Sie einfach Elastic AI Assistant um Hilfe.

Neben den zahlreichen vorkonfigurierten Prompts können Nutzer:innen eigene Prompts hinzufügen und so den Workflow für sich optimieren. Durch diesen individuell anpassbaren Workflow kann Elastic AI Assistant zu einem echten Mitstreiter in Ihrem Team werden.

Auch nachdem die Antwort von Ihrem gewählten LLM zurückgegeben wurde, können Sie die Konversation mit dem Modell weiter fortführen. Elastic AI Assistant fügt jedes Mal den Kontext der Konversation hinzu, und wenn Sie mit den Ergebnissen zufrieden sind, können Sie diese einer Zeitleistenuntersuchung oder einem Fall hinzufügen.

Warum warten? Legen Sie doch einfach los!

Elastic AI Assistant ist jetzt für alle Nutzer:innen verfügbar. Weitere Informationen dazu, wie sie Elastic AI Assistant mit dem Modell Ihrer Wahl integrieren und damit anfangen können, das Potenzial von KI zu nutzen, finden Sie in unserer Dokumentation.

Die Entscheidung über die Veröffentlichung von Features oder Leistungsmerkmalen, die in diesem Blogpost beschrieben werden, oder über den Zeitpunkt ihrer Veröffentlichung liegt allein bei Elastic. Es ist möglich, dass nicht bereits verfügbare Features oder Leistungsmerkmale nicht rechtzeitig oder überhaupt nicht veröffentlicht werden.

In diesem Blogpost haben wir möglicherweise auf generativer KI basierende Tools von Drittanbietern verwendet, die von ihren jeweiligen Eigentümern betrieben werden. Elastic hat keine Kontrolle über die Drittanbieter-Tools und übernimmt keine Verantwortung oder Haftung für ihre Inhalte, ihren Betrieb oder ihre Verwendung sowie für etwaige Verluste oder Schäden, die sich aus der Verwendung solcher Tools durch Sie ergeben. Gehen Sie vorsichtig vor, wenn Sie KI-Tools mit persönlichen, sensiblen oder vertraulichen Daten verwenden. Alle Daten, die Sie eingeben, können für das Training von KI oder andere Zwecke verwendet werden. Es gibt keine Garantie dafür, dass Informationen, die Sie bereitstellen, sicher oder vertraulich behandelt werden. Setzen Sie sich vor der Verwendung von auf generativer KI basierenden Tools mit deren Datenschutzpraktiken und den Nutzungsbedingungen auseinander.

Elastic, Elasticsearch und zugehörige Marken, Waren- und Dienstleistungszeichen sind Marken oder eingetragene Marken von Elasticsearch N.V. in den USA und anderen Ländern. Alle weiteren Marken- oder Warenzeichen sind eingetragene Marken oder eingetragene Warenzeichen der jeweiligen Eigentümer.